联系我们

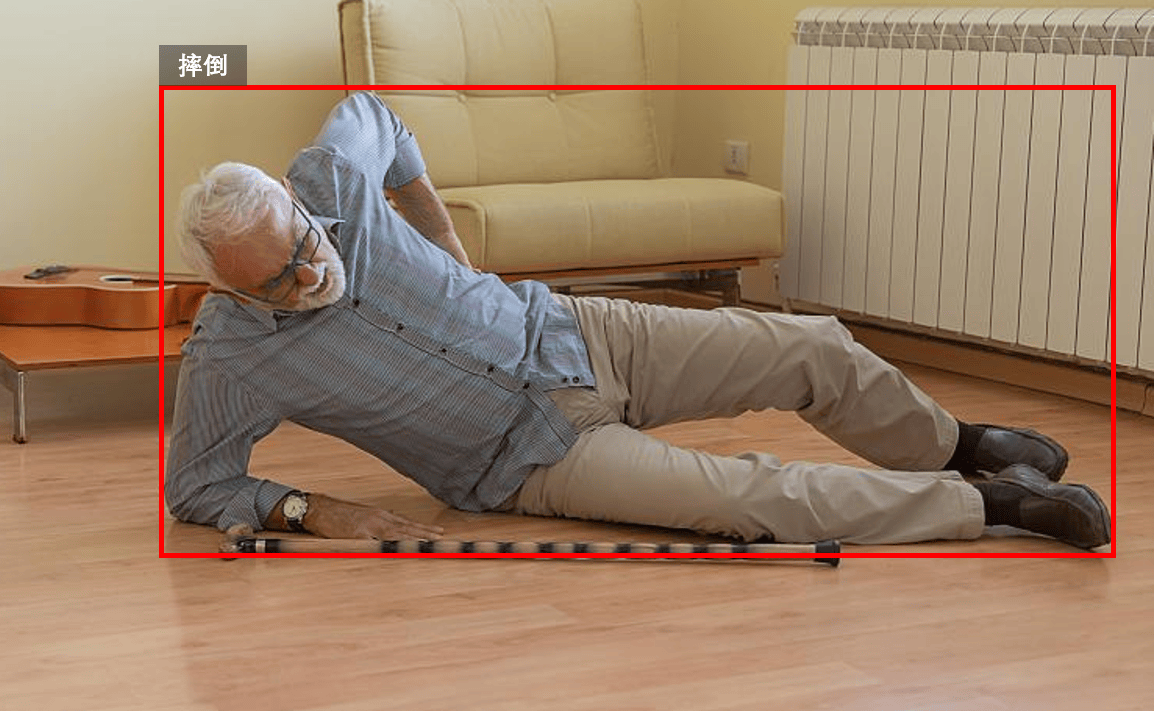

一、方案核心:将 “跌倒行为” 转化为 “目标类别”

传统跌倒检测需经 “人体检测→姿态估计→规则判断” 三步流程(如通过宽高比>1 判定倒地),存在误报率高(弯腰 / 下蹲误判)、逻辑冗余等问题。YOLO12 的突破在于:

标注范式革新

数据集直接标注person-falling(跌倒中)、fallen(已跌倒)等独立类别,而非仅标注 “人”。例如某自建数据集含 3888 张图像,覆盖前倾 / 侧倒 / 后仰等姿态及不同光照背景。

推理逻辑极简

模型输出直接包含跌倒类别置信度与坐标,省去姿态关键点提取、几何特征计算等后处理,代码量减少 60% 以上。

二、准确率反升的三大技术支撑

1. 注意力机制赋能特征学习

YOLO12 引入区域注意力模块(A²) ,将特征图划分为 4×4 区域进行局部自注意力计算,既保留大感受野又使计算量降至传统自注意力的 1/4。该模块让模型精准捕捉跌倒时的躯干姿态、肢体相对位置等核心特征,而非依赖单一宽高比指标,使弯腰与跌倒的区分准确率提升 15% 以上。

2. 网络架构优化保障精度与速度平衡

残差高效层聚合(R-ELAN) :通过残差连接与特征瓶颈结构,解决注意力模型训练不稳定问题,YOLO12-X 在 100 轮训练后收敛精度比 YOLO11 提升 2.3%。

工程级优化:采用 FlashAttention 减少内存延迟、7×7 大卷积增强位置感知,使 YOLO12-N 在 T4 GPU 上推理延迟仅 1.64ms,mAP 达 40.6%(超越 YOLO11-N 1.2%)。

3. 数据驱动的泛化能力提升

结合动态数据增强(Mosaic9 拼接 + HSV 扰动)与难例挖掘(Focal Loss 加权),模型在极端光照、部分遮挡场景下的鲁棒性显著增强。某养老院实测显示,其跌倒识别率达 96.33%,较传统基于 OpenPose 的方案提升 1.5 个百分点。

三、落地价值与实践路径

1. 关键应用场景效能

场景 | 传统方案问题 | YOLO12 方案效果 |

智慧养老 | 误报率>20%,响应延迟 5-8s | 误报率<5%,响应延迟<1s |

商场监控 | 多人重叠时漏检率高 | 支持 8 人同时跟踪,漏检率降 90% |

康复中心 | 无法区分跌倒类型 | 精准分类绊倒 / 滑倒等 4 类场景 |

2. 快速部署指南

# 1. 数据集配置(fall_detection.yaml)

train: ./dataset/train

val: ./dataset/val

nc: 3

names: ['fallen', 'falling', 'stand']

# 2. 模型训练(基于预权重微调)

from ultralytics import YOLO

model = YOLO('yolo12s.pt')

model.train(data='fall_detection.yaml', epochs=100, imgsz=640, batch=16)

# 3. 实时检测

import cv2

model = YOLO('runs/exp/best.pt')

cap = cv2.VideoCapture(0)

while True:

ret, frame = cap.read()

results = model(frame, conf=0.6) # 置信度阈值过滤

annotated_frame = results[0].plot()

cv2.imshow('Fall Detection', annotated_frame)

四、局限性与未来方向

当前方案仍面临隐私保护(需边缘计算本地化处理)、非常规跌倒(如匍匐)识别不足等问题。未来可结合毫米波雷达数据融合,构建 “视觉 + 距离” 双模态检测网络,进一步提升复杂场景适应性。

需求留言:

需求留言: