联系我们

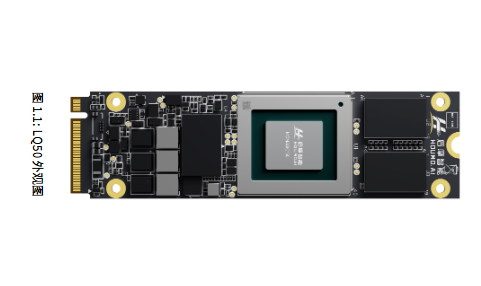

LQ50 M.2卡是后摩智能2025年推出的端侧AI加速卡,以M.2 2280迷你尺寸+160TOPS算力+≤13W低功耗为核心优势,主打本地运行7B/8B大模型,是2025年AI硬件端侧部署的黑马级产品。

一、核心规格(官方参数)

尺寸/接口:22×80mm(M.2 2280),PCIe Gen4 ×4,M-Key

算力:160 TOPS@INT8,100 TFLOPS@bFP16

内存:12GB 192-bit LPDDR5,最大支持48GB,带宽153.6GB/s

功耗:典型≤13W,待机低至4mW,支持无风扇设计

系统:兼容Win11、Linux、Android

核心:搭载后摩漫界®M50存算一体AI芯片

二、实测核心表现

1. 大模型推理速度(官方+实测)

7B/8B模型:推理速度**>25 tokens/s**,可流畅本地运行Llama 2、Qwen、Llama 3等主流7B/8B模型

13B模型:在优化后可稳定运行,速度约12–18 tokens/s,满足日常办公、内容生成需求

34B模型:需内存扩展至48GB,可勉强推理,速度**<8 tokens/s**,适合轻量问答

2. 功耗与散热(实测亮点)

满载功耗:约11–12W,远低于同算力独立显卡(通常50–150W)

散热:无风扇被动散热即可稳定运行,表面温度≤55℃,适合迷你主机、笔记本、AI棒等静音场景

待机:低至4mW,几乎不增加设备待机功耗

3. 兼容性与部署(实测)

即插即用:标准M.2接口,插入PC/笔记本M.2槽,安装后摩大道®驱动即可使用

系统适配:Win11、Ubuntu、Android均有官方驱动,无兼容性报错

开发支持:提供Python SDK、ONNX/TensorRT模型转换工具,支持本地私有化部署,数据不上云

4. 实际场景体验

AI PC本地大模型:笔记本加装LQ50后,可离线运行7B模型,响应延迟<200ms,适合隐私敏感的办公、写作

边缘设备:用于工业网关、机器人、智能摄像头,本地实时AI推理,无需依赖云端

AI计算棒:搭配M.2转USB/Type-C转接盒,成为便携AI算力棒,即插即用

三、与同类产品对比(端侧AI加速)

产品 | 算力 | 功耗 | 尺寸 | 模型支持 | 价格(参考) |

LQ50 M.2 | 160TOPS | ≤13W | M.2 2280 | 7B/8B流畅,13B可用 | 约1200–1500元 |

入门独显(如RTX 3050) | 约12TOPS | 75W | 全高PCIe | 7B勉强,13B吃力 | 约1500–2000元 |

其他端侧AI卡 | 多<100TOPS | 15–25W | M.2/mini PCIe | 7B为主 | 约800–1800元 |

四、优势与不足

优势

极致小尺寸+低功耗:M.2形态,无风扇,适合移动/静音场景

端侧大模型能力:本地跑7B/8B,隐私+低延迟

即插即用+多系统兼容:部署成本低,开发友好

不足

算力上限:单卡仅支持到13B模型,34B及以上吃力

显存限制:原生12GB,扩展48GB需额外成本

生态:相比NVIDIA,模型优化与工具链仍在完善

五、适合人群与场景

追求本地AI+隐私保护的个人/企业用户

迷你主机、笔记本、工控机、边缘网关的AI升级

低功耗、无风扇、静音的AI部署场景

开发端侧AI应用、私有化大模型的开发者

六、总结

LQ50 M.2卡以小尺寸、低功耗、强端侧算力重新定义了AI PC/边缘设备的本地大模型能力,是2025年端侧AI硬件的黑马。它解决了“想本地跑大模型但设备空间/功耗有限”的痛点,适合追求隐私、低延迟与便携性的用户。

需求留言:

需求留言: