联系我们

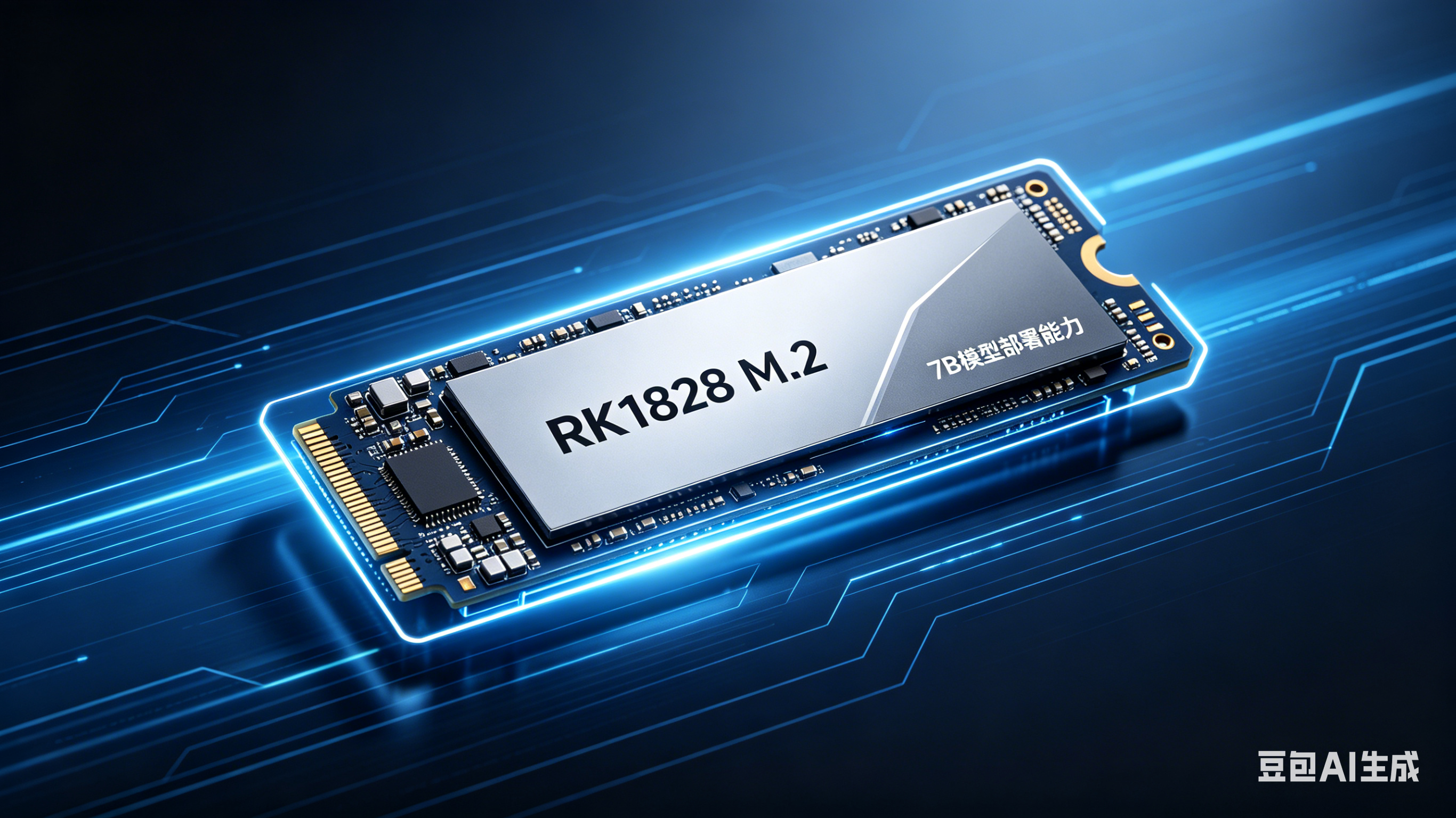

RK1828 是瑞芯微推出的 M.2 接口 AI 算力卡,专为端侧 7B 大语言模型与多模态推理设计,通过 PCIe 2.0 高速互联、集成 5GB 3D 堆叠 DRAM 与 20TOPS INT8 算力,可在边缘设备上实现 100+ token/s 的 7B 模型实时交互,是国产化端侧大模型部署的核心硬件。

一、核心硬件与接口规格

1. 硬件架构

芯片核心:3 核 64 位 RISC-V(SRV/VRV0/VRV1),每核 32KB I-Cache/32KB D-Cache/128KB L2 Cache。

NPU 算力:INT8 精度 20TOPS,支持 INT4/INT8/INT16/FP8/FP16/BF16 混合运算,专为 Transformer 与 LLM 优化。

板载内存:5GB 3D 堆叠 DRAM(RK1820 为 2.5GB),带宽达 1TB/s,可完全载入 7B 模型,消除 PCIe 数据传输瓶颈。

接口形态:M.2 2280 Key‑M,PCIe 2.0 x1(带宽 5Gbps),兼容主流 x86/ARM 平台(如 RK3588、工控机、迷你主机)。

功耗与散热:典型功耗 10W,被动散热即可稳定运行,适配无风扇边缘场景。

2. 与 RK1820 对比

RK1820:2.5GB DRAM,支持≤3B 模型,适合轻量 LLM 与视觉任务。

RK1828:5GB DRAM,原生支持 7B 模型(如 Llama 2‑7B、Qwen‑7B、DeepSeek‑7B),token 速率 59–180 token/s。

二、PCIe 接口工作原理

1. 主机‑协处理器异构架构

主机(如 RK3588/x86):运行 OS、调度任务、数据预处理、轻量推理与外设控制。

RK1828(协处理器):专用 AI 推理引擎,通过 PCIe 2.0 与主机高速通信,接收模型与输入数据,返回推理结果。

数据流向:主机→PCIe→RK1828 DRAM→NPU 推理→结果回传主机,零拷贝设计降低延迟。

2. 接口优势

即插即用:M.2 Key‑M 插槽通用,无需额外供电,适配各类边缘设备。

低延迟高带宽:PCIe 2.0 x1 单向 5Gbps,配合片上高带宽 DRAM,7B 模型推理延迟低至 159ms(DeepSeek‑7B),远优于 Jetson Orin NX(322ms)。

跨平台兼容:支持 Linux/Android,提供 RKNN Toolkit 适配 PyTorch/TensorFlow 模型转换。

三、7B 模型部署全流程

1. 环境准备

硬件:带 M.2 Key‑M 插槽的主机(推荐 RK3588 开发板或 x86 迷你主机),RK1828 算力卡。

软件依赖:

# 安装RKNN Toolkit2(模型转换与推理)

pip install rknn-toolkit2==1.5.0

# 安装依赖

pip install torch transformers sentencepiece accelerate

2. 模型获取与转换(RKNN 格式)

1. 下载 7B 模型:如 Qwen‑7B‑Chat、Llama 2‑7B‑Chat‑HF(需合规获取权重)。

2. 模型转换(PyTorch→RKNN):

from rknn.api import RKNN

rknn = RKNN(verbose=True)

# 加载PyTorch模型

rknn.load_pytorch(model='qwen_7b.pt', input_size_list=[[1, 128]])

# 量化(INT8,平衡精度与速度)

rknn.quantize(quant_type='int8', dataset='calib_data.txt')

# 导出RKNN模型(适配RK1828)

rknn.export_rknn('qwen_7b_rk1828.rknn', target_platform='rk1828')

1. 关键优化:启用KV 缓存(5GB DRAM 可容纳 7B 模型 KV 缓存)、INT4/INT8 混合量化、模型并行分片,确保推理流畅。

3. 板端推理部署

1. 加载 RKNN 模型:

rknn.init_runtime(target='rk1828', device_id='0')

# 输入预处理(tokenization)

input_ids = tokenizer("你好,介绍一下自己", return_tensors='pt').input_ids.numpy()

# 推理(生成回复)

outputs = rknn.inference(inputs=[input_ids])

# 解码输出

response = tokenizer.decode(outputs[0], skip_special_tokens=True)

print(response)

1. 性能调优:

批量推理:batch_size=1–4,平衡吞吐量与延迟。

动态精度:对话场景用 INT4,高敏感任务用 INT8。

显存管理:复用 KV 缓存,避免重复分配内存。

4. 性能基准(7B 模型)

Qwen2.5‑7B:102 token/s,延迟 145ms。

DeepSeek‑R1‑Distill‑7B:56 token/s,延迟 159ms。

Llama 2‑7B‑Chat:89 token/s,延迟 178ms。

四、典型应用场景

1. 端侧 AI 对话终端:离线智能音箱、工业人机界面、车载语音助手,低延迟实时交互。

2. 多模态 AI 设备:视觉‑语言模型(VLM)部署,实现图像描述、OCR+LLM 问答、工业缺陷检测 + 分析。

3. 边缘网关 / 服务器:本地私有大模型部署,数据不出网,适配政务、金融、医疗等隐私敏感场景。

4. 机器人与工控:导航决策、多模态感知、设备故障诊断,低功耗高可靠运行。

五、优势与局限性

优势

国产化自主可控:全国产供应链,成本比 Jetson Orin NX 低 30%,适配国产替代需求。

7B 模型原生支持:5GB 片上 DRAM,无需主机内存交换,推理速度领先同级产品 2–3 倍。

低功耗易部署:10W 功耗,被动散热,M.2 接口即插即用,适配无风扇边缘设备。

局限性

不适合 CNN 任务:对 YOLO/ResNet 等卷积网络无加速优势,专为 Transformer/LLM 优化。

模型上限 7B:5GB DRAM 限制,无法支持 13B 及以上模型。

软件生态待完善:RKNN 工具链对 Hugging Face 模型适配需手动优化,部分算子支持有限。

六、快速上手步骤总结

1. 硬件安装:将 RK1828 插入主机 M.2 Key‑M 插槽,通电识别。

2. 环境配置:安装 RKNN Toolkit2 与依赖库,配置交叉编译工具链。

3. 模型转换:下载 7B 模型,用 RKNN Toolkit2 转为 RKNN 格式并量化。

4. 推理测试:编写 Python 脚本加载模型,输入文本生成回复,验证性能。

5. 应用开发:集成到目标场景(如对话终端、多模态设备),优化参数上线。

需求留言:

需求留言: