联系我们

算能BM1688边缘计算盒子是国产化、低功耗、高性价比的边缘AI私有化部署方案,可稳定运行7B及以下量化大模型,满足本地推理、数据不出域、弱网/离线场景需求。

一、核心硬件与算力(BM1688)

处理器:八核ARM Cortex-A53(1.6GHz)+ 自研TPU

算力规格:

INT8:16 TOPS(峰值)

INT4:32 TOPS(峰值)

FP16/BF16:4 TOPS

FP32:0.5 TOPS

内存/存储:标配8GB LPDDR4X + 32GB eMMC;支持M.2 NVMe SSD扩展

功耗:典型7.2W,最大14.4W(工业级低功耗)

多媒体:16路1080P解码 + 10路编码,支持多路视频AI分析

二、支持的大模型与部署能力

BM1688原生支持Transformer架构,可私有化部署主流开源大模型(量化后):

7B级:Llama 2-7B、ChatGLM3-6B、Qwen-7B(INT4/INT8量化)

轻量级:Gemma-2B、Qwen1.5-1.8B、MiniCPM-2B(可FP16/INT8)

多模态:支持图文理解类模型(如PaddleOCR-VL)

三、私有化部署核心优势

1. 数据安全与隐私:推理全流程本地完成,数据不回传云端,满足政务、金融、工业等合规要求

2. 低延迟/离线可用:本地推理响应<500ms,断网/弱网环境持续可用

3. 成本可控:单台硬件成本低、功耗低,无需持续云服务费用

4. 易集成:提供SOPHON SDK、Docker容器化、RESTful API,快速对接业务系统

四、部署流程(极简版)

1. 模型准备:选择7B及以下模型,用SOPHON SDK做INT4/INT8量化与模型转换

2. 硬件部署:将模型与推理服务打包为Docker镜像,刷入BM1688盒子

3. 本地推理:通过HTTP/GRPC接口调用,实现本地问答、文本生成、语义理解等

4. 优化调参:调整批处理、KV缓存、上下文长度,平衡速度与效果

五、典型应用场景

工业/制造:产线质检、设备故障诊断、本地知识库问答

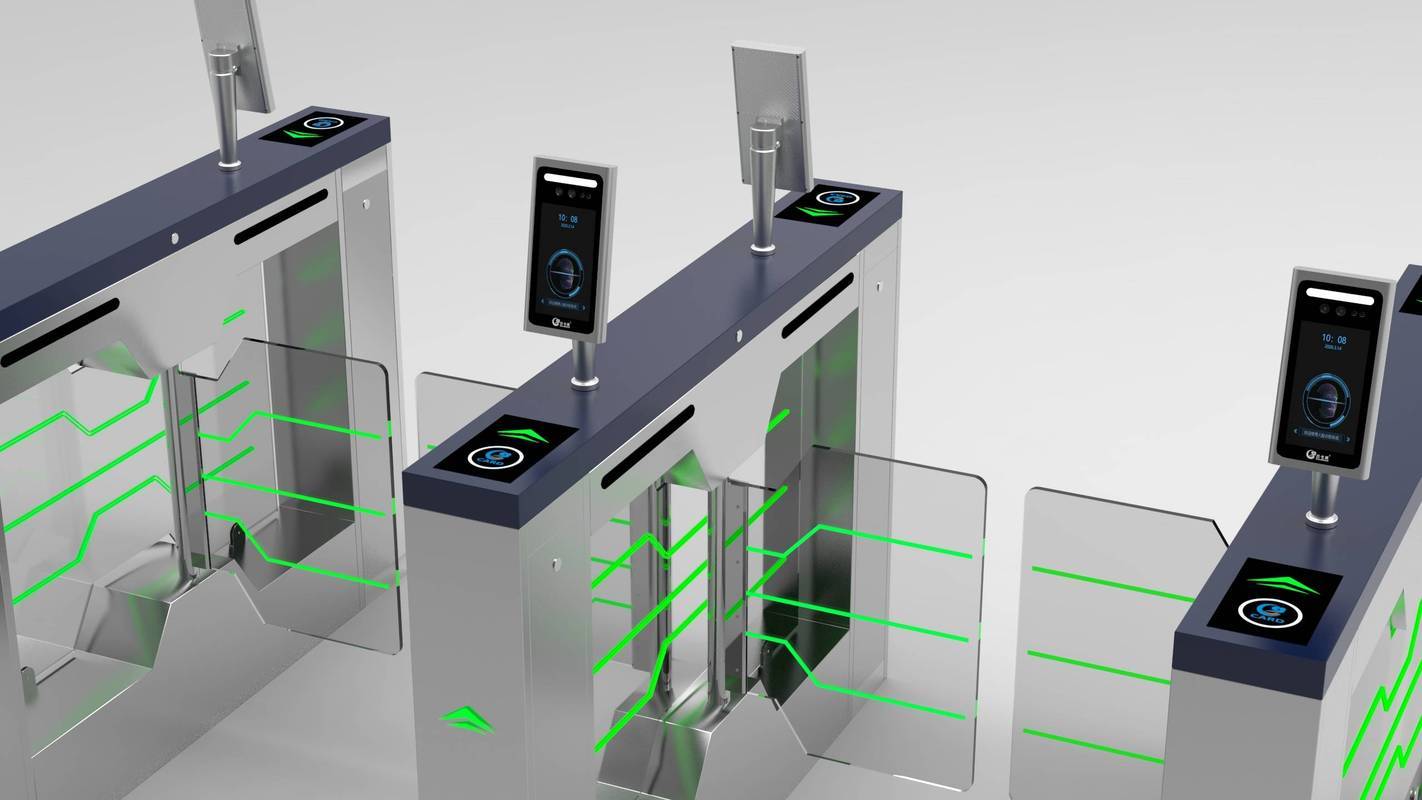

园区/安防:本地视频分析+自然语言交互(如“查找昨天下午3点北门异常”)

零售/门店:离线智能导购、商品识别、本地会员服务

政务/医疗:敏感数据本地处理、内部知识库、离线咨询

六、与云端方案对比

维度 | BM1688边缘私有化 | 云端大模型服务 |

数据安全 | 本地处理,零泄露 | 数据上传,有风险 |

网络依赖 | 离线可用 | 必须联网 |

推理延迟 | 毫秒级 | 秒级(网络+排队) |

长期成本 | 一次性硬件投入 | 持续按量付费 |

模型可控 | 完全自主 | 服务商提供 |

七、选型与实施建议

模型选择:优先7B及以下轻量级模型,INT4量化可显著提升速度与内存适配性

硬件配置:大模型推理建议扩展M.2 SSD(512GB+),提升模型加载与缓存效率

开发工具:使用算能SOPHON SDK、TPU Profiler进行性能调优

BM1688是国产化边缘大模型私有化的高性价比选择,适合需要本地AI能力、数据安全优先、弱网/离线运行的场景。

需求留言:

需求留言: