联系我们

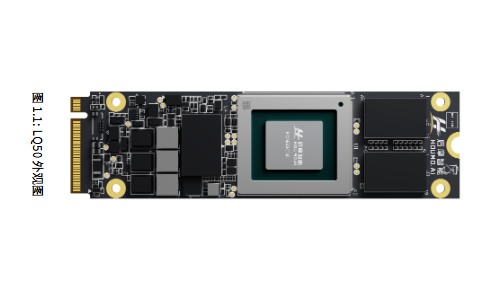

力擎LQ50 M.2卡凭借存算一体架构,在低功耗下实现了远超传统端侧AI模块的算力与大模型推理性能,是端边AI部署的能效优选。

一、核心参数对比(功耗 vs 性能)

1. 力擎LQ50 M.2卡(后摩智能)

物理算力:160 TOPS@INT8,100 TFLOPS@bFP16

典型功耗:≤ 13W(被动散热,无风扇)

内存:12GB LPDDR5(最大48GB),带宽153.6 GB/s

大模型推理:7B/8B模型 > 25 tokens/s

待机功耗:低至 4mW

形态:标准M.2 2280(口香糖大小)

2. 主流传统端侧AI模块(对比)

模块型号 | INT8算力 | 典型功耗 | 能效比(TOPS/W) | 大模型推理能力 |

力擎LQ50 M.2 | 160 TOPS | ≤13W | ≈12.3 | 7B/8B >25 tokens/s |

英伟达Jetson Orin NX | 70–100 TOPS | 10–25W | 4–7 | 7B约10–15 tokens/s |

华为昇腾310P | 176 TOPS | 8–24W | 7.3–22 | 7B约15–20 tokens/s |

比特大陆BM1684X (SM7) | 17.6 TOPS | 17W | ≈1.0 | 轻量级模型为主 |

英特尔Myriad X | 4 TOPS | 2–5W | 0.8–2.0 | 轻量级CV/语音 |

二、关键差异解析

1. 功耗控制(LQ50优势显著)

LQ50:≤13W即可跑满160TOPS,支持被动无风扇,适合静音/移动/嵌入式场景。

传统模块:同算力下功耗普遍15–25W,需主动散热,体积与噪音更大。

2. 性能与大模型适配(LQ50领先)

算力密度:LQ50在M.2小尺寸下实现160TOPS,是传统端侧模块的2–10倍。

大模型推理:LQ50原生支持7B/8B模型 >25 tokens/s,可本地跑百亿参数模型;传统模块多需降频/量化,速度仅10–15 tokens/s。

内存带宽:153.6 GB/s,满足大模型权重快速加载,减少延迟。

3. 架构与能效比(核心差异)

LQ50:基于**存算一体(CIM)**架构,计算在内存中完成,大幅降低数据搬运功耗,能效比≈12.3 TOPS/W。

传统模块:多为GPU/TPU/DaVinci架构,依赖外部内存,数据搬运功耗高,能效比普遍**<10 TOPS/W**。

4. 形态与部署

LQ50:标准M.2 2280,即插即用,适配AI PC、机器人、边缘盒子等。

传统模块:多为SOM/PCIe形态,体积更大,部署复杂度更高。

三、适用场景对比

力擎LQ50 M.2:

AI PC、AI计算棒、移动机器人

静音/低功耗嵌入式设备

本地大模型推理(7B–32B)

边缘计算盒子、智能网关

传统AI模块:

轻量级CV/语音(Myriad X、BM1684X)

工业视觉、安防(昇腾310P)

通用边缘AI(Jetson Orin NX)

四、总结

功耗:LQ50 ≤13W,传统模块多15–25W → LQ50低30%–50%。

性能:LQ50 160TOPS,7B>25 tokens/s → 算力与大模型速度均领先。

能效比:LQ50 ≈12.3 TOPS/W → 是传统模块的1.5–3倍。

结论:在端侧/边缘AI场景,力擎LQ50 M.2在功耗、性能、能效比上全面优于传统AI模块,尤其适合需要本地大模型、低功耗、小体积的应用。

需求留言:

需求留言: