联系我们

瑞芯微 RK1828 是专为端侧大模型推理设计的AI协处理器,核心优势是3D堆叠高带宽内存+20TOPS NPU,可稳定实现百token/s级极速推理,完美适配3B–7B参数大模型本地部署。

一、核心定位与架构

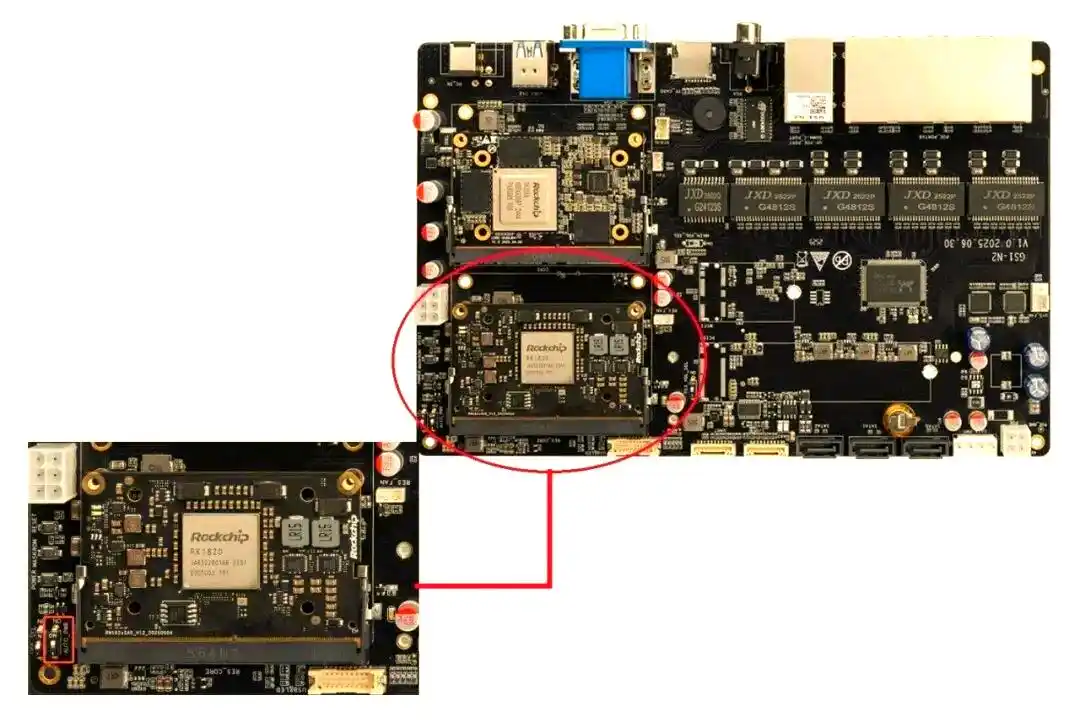

RK1828 是 RK182X 系列旗舰型号,定位端侧大模型专用算力协处理器,主打低延迟、高吞吐、低功耗的本地AI推理。

核心架构:三核64位RISC-V + 专用NPU,通过PCIe 3.0与RK3588等主控协同,分工明确(主控调度/预处理,RK1828专注推理)。

3D堆叠内存(最大亮点):内置5GB高带宽DRAM,理论带宽1TB/s,实测百GB/s级,彻底解决大模型“内存墙”瓶颈,无需外挂DDR。

NPU算力:20TOPS@INT8,支持INT4/INT8/INT16/FP8/FP16/BF16混合精度与硬件稀疏计算,适配主流大模型量化。

二、百token/s极速推理实测(官方数据)

在最新SDK优化下,RK1828在主流大模型上实现百token/s级稳定输出:

模型 | 推理性能(Decode TPS) | 首字延迟(TTFT) |

Qwen2.5-3B | 102.01 token/s | 约100ms |

Qwen2.5-0.5B | 215.86 token/s | 21.89ms |

Qwen3-8B | 61.11 token/s | 约160ms |

Qwen 3B VLM(多模态) | 80+ token/s | 约100ms |

核心结论:3B参数模型稳定破百token/s,7B模型50–80+ token/s,端到端延迟**<200ms**,达到“云端级响应”体验。

三、技术优势:为什么能做到百token/s?

1. 高带宽内存(HBM):3D堆叠提供1TB/s理论带宽,数据传输无瓶颈,大模型权重加载与推理数据流零阻塞。

2. 专用NPU+RISC-V协同:NPU专注矩阵运算,RISC-V处理控制与调度,硬件级并行,算力利用率超90%。

3. 深度模型优化:瑞芯微RKNN Toolkit对LLM/VLM做算子融合、量化与稀疏加速,解码效率提升15%+。

4. 低功耗设计:整芯片功耗**<15W**,适合边缘/嵌入式场景长期稳定运行。

四、典型应用场景

智能座舱:RK3588M+RK1828打造AI Box,本地运行7B语音助手,首字<100ms,支持多模态交互、DMS/OMS,数据不出车。

工业/机器人:端侧部署7B视觉大模型,百token/s输出,实时SLAM、质检、物体抓取,替代工控机,成本降50%。

边缘AI服务器/NVR:多RK1828叠加算力,本地处理多路4K/8K视频,实时分析、摘要、检索,隐私安全。

智能家居/教育:离线语音翻译、本地大模型问答,无网络依赖,响应快、隐私强。

五、与同类方案对比(端侧大模型)

方案 | 算力 | 内存 | 3B模型TPS | 功耗 | 优势 |

RK1828 | 20TOPS | 5GB HBM | 102 | <15W | 高带宽、低延迟、百token/s |

Jetson Orin NX | 20–100TOPS | 8GB LPDDR5 | 60–80 | 10–25W | 通用性强、生态完善 |

其他端侧NPU | 10–15TOPS | 1–2GB | 30–50 | 8–12W | 成本低、带宽不足 |

六、开发与部署

开发套件:Firefly RK1828开发板(RK3588+RK1828),PCIe直连,开箱即用,支持RKNN、ONNX、PyTorch、TensorFlow模型转换。

模型支持:原生适配Qwen、Llama 2、DeepSeek、通义千问等3B/7B/8B模型,支持VLM多模态推理。

扩展能力:支持多片RK1828通过PCIe级联,算力线性叠加,适配更高算力需求场景。

总结

RK1828以3D堆叠高带宽+20TOPS NPU+深度模型优化,在端侧实现百token/s级极速推理,是3B–7B大模型本地部署的理想选择,尤其适合智能座舱、工业机器人、边缘AI等对延迟与隐私要求高的场景。

需求留言:

需求留言: