联系我们

瑞芯微RK3588大模型一体机,本地可稳定跑通7B级大模型,13B级可勉强运行,30B级受硬件限制无法本地部署。以下从硬件能力、部署方案、性能与限制、一体机选型等方面详细说明:

一、RK3588核心硬件能力(支撑大模型运行)

核心算力:8nm工艺,八核CPU(4×A76@2.4GHz+4×A55@1.8GHz),集成6TOPS INT8 NPU,支持INT4/INT8/INT16/FP16混合量化。

内存与带宽:最高支持32GB LPDDR5,大带宽可满足7B/13B量化模型权重加载与KV缓存需求。

系统与工具:兼容Linux/Android,官方提供RKLLM工具链,可将Hugging Face/GGUF模型转为适配NPU的RKLLM格式,实现NPU硬件加速。

二、7B–30B模型本地部署可行性(实测结论)

1. 7B模型:可稳定本地运行(推荐)

硬件要求:必须16GB及以上内存(8GB无法加载),建议32GB以保证流畅度。

量化方案:采用INT4/INT8量化(RKLLM工具链),大幅降低显存/内存占用。

性能表现:Qwen2.5-7B等模型,首帧延迟约160ms,生成速度TPS>50,可满足本地对话、知识库问答等场景。

适配模型:Qwen-7B、DeepSeek-7B、Llama2-7B、Mistral-7B等主流开源模型均已适配。

2. 13B模型:可勉强运行(不推荐)

硬件要求:必须32GB内存,且需极致INT4量化。

性能表现:推理速度降至个位数TPS,响应慢、卡顿明显,仅适合非实时、短文本场景。

限制:NPU算力与内存带宽不足,无法流畅支撑13B模型实时交互。

3. 30B模型:无法本地部署

核心瓶颈:30B模型即使INT4量化,仍需约15GB+显存/内存,且对算力、带宽要求远超RK3588硬件上限。

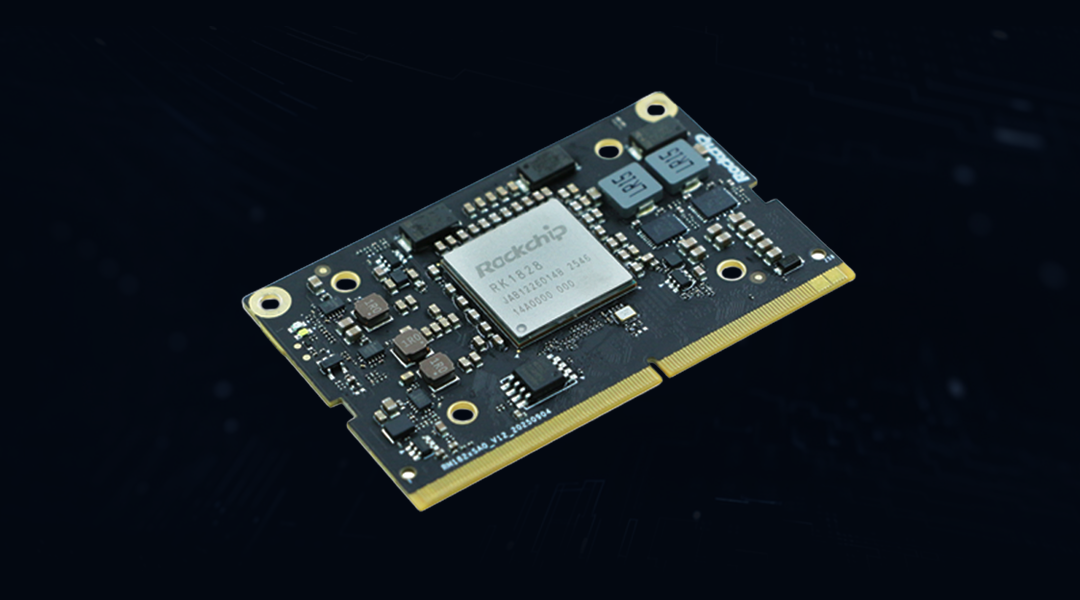

替代方案:需搭配RK182X协处理器扩展算力(8–128TOPS),或采用云端+端侧混合部署。

三、RK3588大模型一体机部署方案

1. 官方工具链(RKLLM)

模型转换:用RKLLM-Toolkit将Hugging Face/GGUF模型转为RKLLM格式。

推理运行:板端通过RKLLM Runtime调用NPU驱动,实现模型推理。

优势:NPU硬件加速,能效比高,开发便捷。

2. 硬件配置推荐(一体机选型)

7B模型:RK3588 + 16GB LPDDR5 + 256GB SSD,双千兆网、WiFi6。

13B模型:RK3588 + 32GB LPDDR5 + 512GB SSD,建议搭配散热强化方案。

主流一体机:Firefly EC-A3588JD4、定昌RK3588工业主机、香橙派5 Max等,均支持上述配置。

四、适用场景与限制

1. 适用场景(7B模型)

本地私有化部署:企业知识库、智能客服、工业质检、边缘网关、智能座舱等,数据不出设备,隐私安全。

低功耗边缘AI:无网/弱网环境,7×24小时稳定运行,功耗<30W。

多模态交互:搭配RK3588 8K编解码、多屏异显能力,支持视觉问答、文档分析等。

2. 核心限制

算力上限:NPU仅6TOPS,无法支撑13B+模型实时交互。

内存瓶颈:32GB为物理上限,30B模型无本地部署可能。

速度衰减:模型越大,推理速度越慢,7B以上体验显著下降。

五、总结与选型建议

7B模型:RK3588一体机是高性价比本地部署方案,稳定、低功耗、隐私安全,推荐选用16GB+内存配置。

13B模型:仅适合非实时场景,需32GB内存,体验一般,谨慎选择。

30B模型:不建议本地部署,可考虑RK3588+RK182X协处理器组合,或云端方案。

需求留言:

需求留言: