联系我们

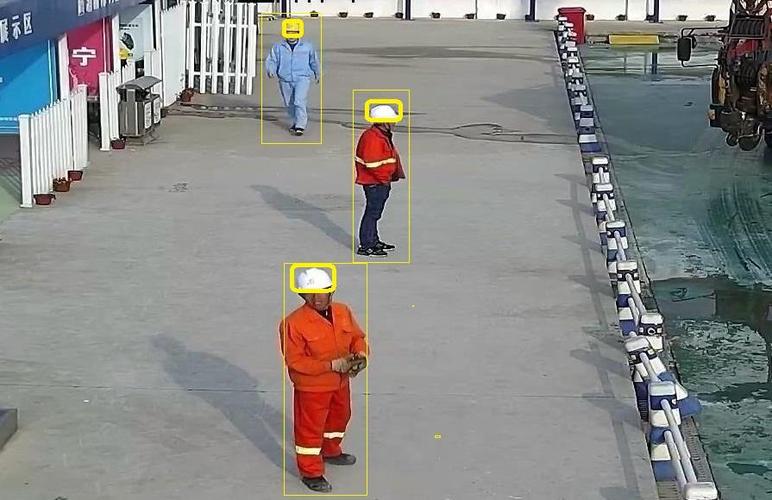

你想了解针对安全帽识别场景中常见的小目标、遮挡、暗光这三大挑战的AI算法解决方案,我会从算法优化、数据处理和工程实践角度,为你系统地讲解具体的解决思路和实现方法。

一、核心问题分析与整体解决思路

安全帽识别属于工业场景下的目标检测任务,三大核心问题的本质和解决方向如下:

问题类型 | 核心痛点 | 核心解决思路 |

小目标 | 特征信息少、检测漏检率高 | 特征增强 + 多尺度检测 + 高分辨率输入 |

遮挡 | 目标完整性缺失、特征不连续 | 上下文信息利用 + 关键点辅助 + 注意力机制 |

暗光 | 图像信噪比低、特征提取失效 | 图像预处理 + 光照鲁棒性训练 + 域自适应 |

二、分场景具体解决方案(附核心代码)

1. 小目标安全帽检测解决方案

关键技术

高分辨率输入与特征融合:提升输入图像分辨率,结合FPN/PAFPN等多尺度特征融合网络,增强小目标特征表达。

锚框(Anchor)优化:针对安全帽尺寸定制锚框比例,增加小尺寸锚框数量。

小目标数据增强:对小目标进行裁剪、缩放、复制粘贴等增强,提升小目标样本占比。

核心实现代码(基于YOLOv8为例)

from ultralytics import YOLO

import cv2

import albumentations as A

# 1. 小目标数据增强配置(Albumentations)

small_obj_aug = A.Compose([

# 随机裁剪小目标区域并放大

A.RandomSizedCrop(min_max_height=(200, 640), height=640, width=640, p=0.5),

# 小目标复制粘贴增强

A.CoarseDropout(max_holes=8, max_height=32, max_width=32, min_holes=2,

min_height=8, min_width=8, fill_value=0, p=0.3),

# 多尺度缩放,重点保留小目标

A.MultiScaleResize(scale_range=(0.5, 2.0), p=1.0),

], bbox_params=A.BboxParams(format='yolo', label_fields=['class_labels']))

# 2. YOLOv8小目标优化配置

def train_yolov8_small_obj():

# 加载预训练模型

model = YOLO('yolov8s.pt')

# 定制小目标锚框(安全帽常见尺寸:10-50像素)

small_anchors = [[10,10], [20,20], [30,30], [40,40], [50,50]]

model.model.args['anchors'] = small_anchors

# 训练配置:高分辨率输入、增强小目标检测

results = model.train(

data='safety_hat.yaml', # 数据集配置文件

imgsz=1280, # 高分辨率输入(提升小目标特征)

epochs=100,

batch=8,

lr0=0.01,

augment=True, # 开启数据增强

hsv_h=0.015, # 色彩增强(辅助暗光场景)

hsv_s=0.7,

hsv_v=0.4,

mixup=0.1, # 混合增强

copy_paste=0.3, # 小目标复制粘贴增强

device=0, # GPU加速

)

return results

# 3. 推理时小目标后处理优化

def detect_small_obj(image_path, model):

# 读取图像

img = cv2.imread(image_path)

# 多尺度推理(提升小目标召回率)

results = model(img, imgsz=[640, 1280], conf=0.25, iou=0.45)

# 小目标置信度修正(避免漏检)

for r in results:

boxes = r.boxes

for box in boxes:

# 小目标(面积<1000像素)提升置信度

area = (box.xyxy[0][2] - box.xyxy[0][0]) * (box.xyxy[0][3] - box.xyxy[0][1])

if area < 1000:

box.conf = box.conf * 1.2 # 置信度提升20%

return results

2. 遮挡场景解决方案

关键技术

关键点辅助检测:检测安全帽的关键特征点(如帽檐、logo位置),即使部分遮挡也能通过关键点判断。

注意力机制:引入CBAM/CA注意力模块,聚焦安全帽可见区域。

上下文信息利用:结合人体检测结果,在人头区域内优先检测安全帽。

核心实现代码

import torch

import torch.nn as nn

# 1. CBAM注意力模块(增强可见区域特征)

class CBAM(nn.Module):

def __init__(self, channel, reduction=16):

super(CBAM, self).__init__()

# 通道注意力

self.avg_pool = nn.AdaptiveAvgPool2d(1)

self.max_pool = nn.AdaptiveMaxPool2d(1)

self.fc = nn.Sequential(

nn.Linear(channel, channel // reduction),

nn.ReLU(inplace=True),

nn.Linear(channel // reduction, channel)

)

# 空间注意力

self.spatial = nn.Sequential(

nn.Conv2d(2, 1, 7, padding=3, bias=False),

nn.Sigmoid()

)

self.sigmoid = nn.Sigmoid()

def forward(self, x):

# 通道注意力

avg_out = self.fc(self.avg_pool(x).view(x.size(0), -1)).view(x.size(0), -1, 1, 1)

max_out = self.fc(self.max_pool(x).view(x.size(0), -1)).view(x.size(0), -1, 1, 1)

channel_att = self.sigmoid(avg_out + max_out)

x = x * channel_att

# 空间注意力

avg_out = torch.mean(x, dim=1, keepdim=True)

max_out, _ = torch.max(x, dim=1, keepdim=True)

spatial_att = self.spatial(torch.cat([avg_out, max_out], dim=1))

x = x * spatial_att

return x

# 2. 结合人体检测的遮挡安全帽识别

def detect_occluded_hat(image_path, hat_model, person_model):

# 第一步:检测人体

person_results = person_model(image_path)

person_boxes = person_results[0].boxes

# 第二步:在人体头部区域内检测安全帽

hat_detections = []

for person_box in person_boxes:

# 提取人体头部区域(上1/3部分)

x1, y1, x2, y2 = person_box.xyxy[0]

head_y1 = y1

head_y2 = y1 + (y2 - y1) * 0.3

head_region = img[int(head_y1):int(head_y2), int(x1):int(x2)]

# 在头部区域内检测安全帽

if head_region.size > 0:

hat_results = hat_model(head_region, conf=0.2)

# 映射回原图坐标

for hat_box in hat_results[0].boxes:

hx1, hy1, hx2, hy2 = hat_box.xyxy[0]

hat_box.xyxy[0] = [x1+hx1, head_y1+hy1, x1+hx2, head_y1+hy2]

hat_detections.append(hat_box)

return hat_detections

3. 暗光场景解决方案

关键技术

图像预处理增强:使用Retinex、CLAHE等算法提升暗光图像质量。

光照鲁棒性训练:在训练数据中加入暗光增强样本,提升模型泛化能力。

低照度图像增强网络:如Zero-DCE、LLNet等,预处理提升图像质量。

核心实现代码

import cv2

import numpy as np

# 1. 暗光图像预处理(Retinex算法)

def retinex_enhance(image, sigma_list=[15, 80, 250]):

"""Retinex算法:提升暗光图像的对比度和细节"""

img = image.astype(np.float64) + 1e-6 # 避免除零

# 多尺度高斯滤波

retinex = np.zeros_like(img)

for sigma in sigma_list:

gaussian = cv2.GaussianBlur(img, (0, 0), sigma)

retinex += np.log10(img) - np.log10(gaussian)

retinex = retinex / len(sigma_list)

# 归一化

retinex = (retinex - np.min(retinex)) / (np.max(retinex) - np.min(retinex)) * 255

retinex = np.clip(retinex, 0, 255).astype(np.uint8)

# CLAHE增强对比度

clahe = cv2.createCLAHE(clipLimit=2.0, tileGridSize=(8,8))

if len(retinex.shape) == 3:

retinex_yuv = cv2.cvtColor(retinex, cv2.COLOR_BGR2YUV)

retinex_yuv[:,:,0] = clahe.apply(retinex_yuv[:,:,0])

retinex = cv2.cvtColor(retinex_yuv, cv2.COLOR_YUV2BGR)

else:

retinex = clahe.apply(retinex)

return retinex

# 2. 暗光场景推理流程

def detect_low_light_hat(image_path, model):

# 读取暗光图像

img = cv2.imread(image_path)

# 暗光增强预处理

enhanced_img = retinex_enhance(img)

# 模型推理

results = model(enhanced_img, conf=0.2, iou=0.45)

return results, enhanced_img

# 3. 训练时的暗光数据增强

def low_light_augmentation(image):

"""模拟暗光场景,用于训练数据增强"""

# 随机降低亮度

brightness = np.random.uniform(0.1, 0.7)

image = cv2.convertScaleAbs(image, alpha=1, beta=brightness*255 - 255)

# 添加噪声(模拟暗光下的传感器噪声)

noise = np.random.normal(0, np.random.uniform(5, 20), image.shape)

image = np.clip(image + noise, 0, 255).astype(np.uint8)

return image

三、工程落地建议

1. 模型选型:优先选择YOLOv8/YOLOv9(小目标优化版)、PP-YOLOE+(工业场景优化),或Faster R-CNN(精度优先)。

2. 数据策略:

小目标:收集大量小尺寸安全帽样本,标注时精准框选。

遮挡:标注不同遮挡程度(部分遮挡、严重遮挡)的样本。

暗光:采集夜间/低照度场景数据,或通过算法生成暗光样本。

3. 后处理优化:

小目标:降低置信度阈值,提升召回率。

遮挡:结合人体姿态信息(如头部关键点)辅助判断。

暗光:推理前统一进行图像增强预处理。

总结

1. 小目标解决核心:高分辨率输入 + 多尺度特征融合 + 小目标数据增强,提升小目标特征提取能力。

2. 遮挡解决核心:注意力机制聚焦可见区域 + 人体上下文信息辅助 + 关键点检测补充。

3. 暗光解决核心:Retinex/CLAHE图像预处理增强 + 暗光数据训练 + 光照鲁棒性优化。

需求留言:

需求留言: