联系我们

物品遗留与保全检测算法是计算机视觉与智能安防领域的核心技术之一,其核心目标是自动识别监控场景中 “非预期停留的物品”(遗留物),并结合 “物品安全状态监测”(保全),最终实现异常事件预警(如遗落行李、遗忘包裹)与安全防护(如物品被破坏、盗取)。该技术广泛应用于地铁站、机场、商场、仓库、银行等对 “空间物品安全性” 有高需求的场景。

一、核心概念与应用场景

在深入技术前,需先明确两个关键定义,避免与相似技术混淆:

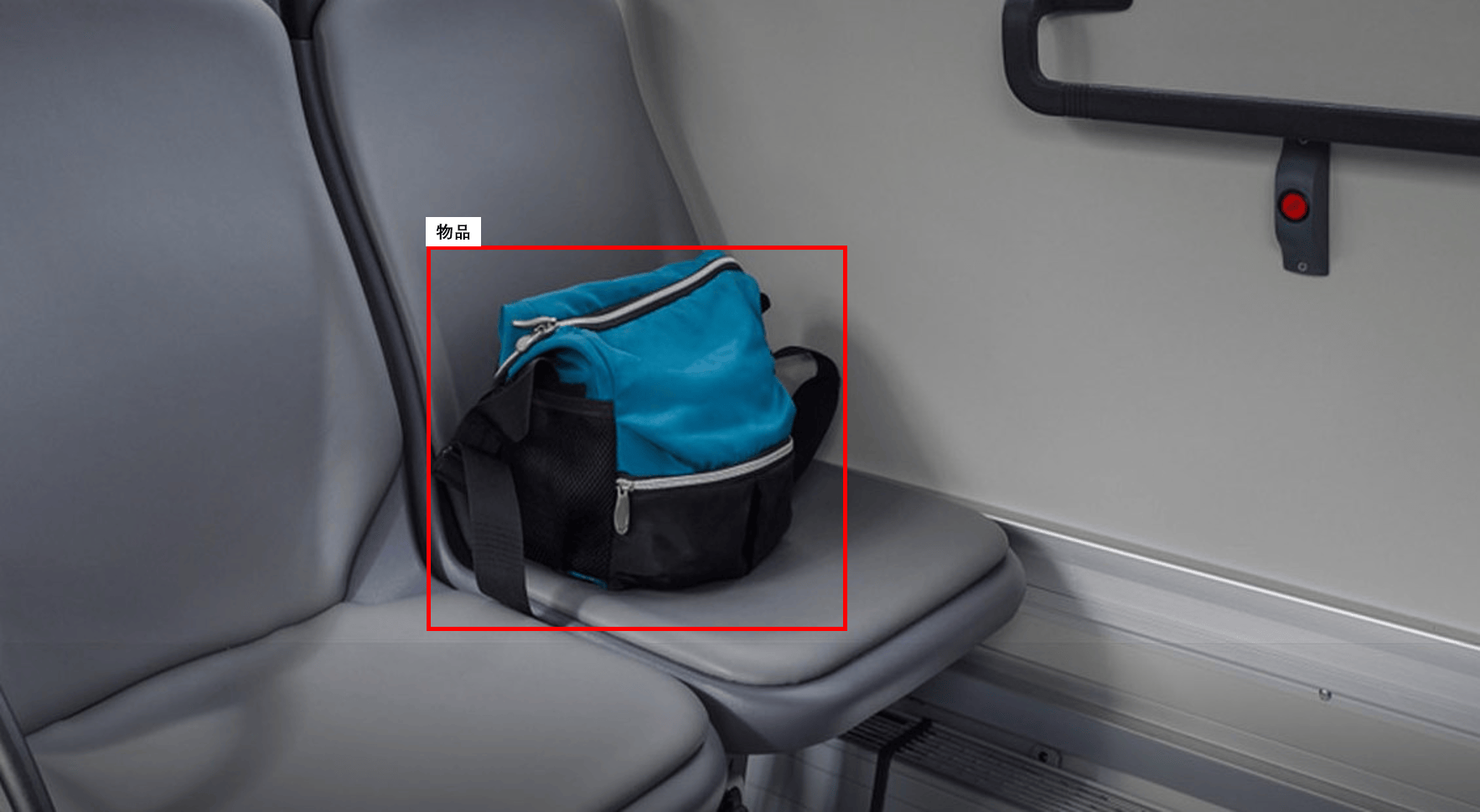

物品遗留:指物品在 “非预设区域” 或 “超出合理停留时间” 的状态,例如:乘客在地铁站台遗落背包、顾客在商场座位遗忘手机、仓库货物偏离指定货架。

物品保全:指对已确认的 “合法物品”(如柜台展品、仓库库存)或 “遗留物品”(待处理)的安全状态监测,例如:展品被触摸、遗留包裹被翻动、仓库货物被搬运。

典型应用场景

场景类型 | 遗留检测需求 | 保全检测需求 |

交通枢纽(地铁 / 机场) | 旅客遗落行李、包裹、随身物品 | 遗留物品被恶意触碰、搬运、破坏 |

商业场所(商场 / 超市) | 顾客遗忘手机、钱包、购物袋 | 柜台展品被拆解、货架商品被偷拿 |

工业场景(仓库 / 车间) | 工具、零件遗落在非存放区(如流水线) | 库存货物被未授权搬运、设备配件被拆卸 |

公共空间(公园 / 图书馆) | 市民遗忘水杯、书籍、儿童玩具 | 遗留物品被他人拾取、公共设施被损坏 |

二、算法核心技术模块

物品遗留与保全检测算法并非单一技术,而是由 **“目标检测 - 静态分析 - 状态跟踪 - 异常判定 - 保全预警”** 五大模块组成的技术栈,各模块协同实现从 “感知” 到 “决策” 的全流程。

模块 1:目标检测与分割(感知层)

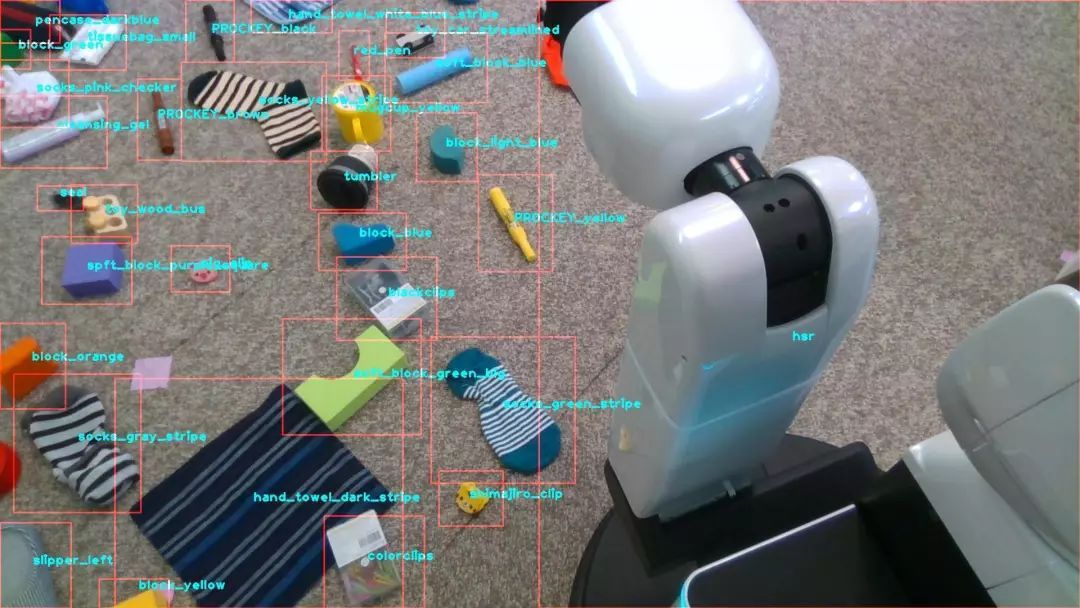

核心任务:从监控视频帧中精准识别 “物品”(如行李、包裹、工具)与 “背景”(如地面、座椅、货架)的边界,为后续分析提供 “目标对象”。

这是算法的基础,若目标检测精度不足(如漏检小物品、误将背景(如石头)识别为物品),会直接导致后续遗留判定错误。

常用技术方案

技术类型 | 代表算法 / 模型 | 优势 | 适用场景 |

传统目标检测 | Haar-like 特征 + Adaboost、HOG+SVM | 轻量、速度快、硬件要求低 | 简单场景(如固定背景、大物品) |

深度学习检测 | YOLOv8、Faster R-CNN、RetinaNet | 精度高、支持小目标(如手机)、多类别识别 | 复杂场景(动态背景、多物品重叠) |

实例分割 | Mask R-CNN、SAM(Segment Anything) | 可区分物品像素级边界(如包裹破损) | 需精细分析的场景(如展品完整性检测) |

关键优化点

多类别适配:需支持 “行李、包裹、手机、工具” 等多类物品的识别,避免仅能检测单一类型;

小目标增强:通过 “特征金字塔(FPN)” 或 “注意力机制” 提升小物品(如钥匙、U 盘)的检测率;

实时性平衡:在安防场景中,检测速度需满足25fps 以上(实时视频流处理),因此需在 “精度(如 YOLOv8-large)” 与 “速度(如 YOLOv8-nano)” 间权衡。

模块 2:静态目标分析(遗留判定层)

核心任务:区分 “移动中的物品”(如行人携带的背包)与 “静止的物品”(可能为遗留物),并通过 “停留时间 + 位置合理性” 判定是否为 “遗留物”。

这是算法的核心差异化模块 —— 不同于 “目标跟踪”(关注移动对象),该模块聚焦 “静态目标的异常性”。

核心技术方法

背景建模与前景提取

通过建立 “动态背景模型”,将视频帧分为 “背景(如地面、座椅)” 和 “前景(如行人、物品)”,再筛选出 “前景中静止的区域”(疑似遗留物)。

常用模型:混合高斯模型(GMM)、自适应背景混合模型(ABM)、ViBe(视觉背景提取);

优势:可应对轻微背景变化(如灯光闪烁、树叶晃动)。

静态目标确认与跟踪

对 “疑似静止的前景区域”,通过以下条件确认是否为 “待判定物品”:连续 N 帧(如 30 帧,约 1 秒)内位置变化小于阈值(如 5 像素);面积稳定(排除阴影、光斑等临时干扰);与 “动态目标(如行人)” 的关联度:若物品与行人分离后静止,优先判定为 “潜在遗留物”。

遗留判定规则

满足以下任一条件,判定为 “遗留物”:

时间规则:静态物品停留时间超过 “场景阈值”(如地铁站 5 分钟、商场 10 分钟);

位置规则:静态物品位于 “禁止停留区域”(如安检口、消防通道);

关联规则:物品与 “最后接触的行人” 距离超过阈值(如 10 米),且行人未返回。

模块 3:环境鲁棒性优化(抗干扰层)

实际监控场景中,“光照变化、遮挡、动态背景” 等干扰会严重影响算法精度,因此需加入 “抗干扰模块” 确保稳定性。

典型干扰与解决方案

干扰类型 | 问题表现 | 解决方案 |

光照变化 | 强光 / 阴影导致物品颜色 / 轮廓失真,误判为遗留物 | 1. 直方图均衡化、Retinex 图像增强;2. 基于灰度 / 纹理的特征提取(减少颜色依赖);3. 多光谱融合(如可见光 + 红外) |

遮挡 | 行人 / 物体遮挡遗留物,导致漏检或误判为 “已移除” | 1. 多摄像头视角融合(如正面 + 侧面);2. 遮挡区域补全(基于上下文预测物品轮廓);3. 遮挡解除后重新确认 |

动态背景 | 晃动的树叶、行驶的车辆、流动的人群干扰前景提取 | 1. 动态背景更新(如 GMM 的自适应学习率);2. 基于运动矢量的干扰过滤(区分 “物品静止” 与 “背景运动”) |

相似物品干扰 | 地面污渍、丢弃的纸巾误判为遗留物 | 1. 物品类别过滤(仅检测 “有价值 / 有安全风险的物品”);2. 纹理 + 形状特征融合(如区分 “背包” 与 “污渍”) |

模块 4:物品保全状态分析(安全判定层)

“保全” 是 “遗留检测” 的延伸 —— 当物品被判定为 “遗留物” 或 “合法物品” 后,需监测其 “安全状态”,识别 “破坏、盗取、非法接触” 等风险行为。

核心保全检测场景与技术

物品完整性检测

任务:识别物品是否被破损、拆解(如包裹被撕开、展品被打碎);

技术:通过 “物品模板匹配”(将当前帧与物品初始帧的轮廓 / 纹理对比)或 “异常区域分割”(如 SAM 分割出破损部分)。

非法接触检测

任务:识别 “未授权人员” 触碰 / 搬运物品;

技术:1. 检测 “人体部位(手、躯干)” 与物品的交集(IOU>0.3 判定为接触);2. 结合行为分析(如 “弯腰 + 手部靠近物品” 判定为搬运意图)。

物品移除检测

任务:识别遗留物 / 合法物品被非法移除;

技术:1. 静态目标消失检测(若遗留物在连续帧中消失,且无授权人员操作,触发预警);2. 区域入侵检测(物品移除后,原位置被 “非授权目标” 占据)。

三、算法执行全流程

以 “地铁站监控场景” 为例,完整流程如下:

数据采集:通过固定摄像头采集 1080P/4K 视频流(帧率 25fps),并传输至边缘计算设备(低延迟需求);

预处理:对每帧图像进行 “去噪(高斯滤波)→ 图像增强(直方图均衡化)→ 尺寸缩放(适配模型输入)”;

目标检测:用 YOLOv8 检测帧中的 “物品(如背包、手机)” 与 “行人”,输出目标边界框与类别;

静态目标筛选:通过 “背景建模(ViBe)” 提取前景,筛选出 “连续 30 帧静止的物品”,并关联 “最后接触的行人”;

遗留判定:若静止物品停留时间超过 5 分钟,且关联行人未返回,判定为 “遗留物”,触发一级预警(如声光提示);

保全监测:对 “遗留物”,实时监测 “是否有人员接触、物品是否破损、是否被移除”,若检测到风险行为,触发二级预警(如通知安保人员);

结果输出:将 “遗留物位置、类型、停留时间、风险行为截图” 推送至安防平台,并保存录像片段(用于追溯)。

四、性能评估指标

算法的优劣需通过 “精度、召回率、实时性” 等指标量化,不同场景对指标的优先级不同(如地铁站需高召回率,避免漏检危险物品)。

指标名称 | 定义 | 计算公式 | 目标值(安防场景) |

准确率(Precision) | 判定为 “遗留物” 的结果中,实际为遗留物的比例 | TP/(TP+FP),TP = 真阳性,FP = 假阳性 | ≥95%(减少误报,避免浪费人力) |

召回率(Recall) | 实际遗留物中,被算法正确检测出的比例 | TP/(TP+FN),FN = 假阴性 | ≥98%(减少漏检,避免安全风险) |

误报率(FPR) | 非遗留物被误判为遗留物的比例 | FP/(FP+TN),TN = 真阴性 | ≤0.1%(避免频繁无效预警) |

检测延迟 | 从物品静止到判定为遗留物的时间 | 实际停留时间 - 设定阈值时间 | ≤1 秒(快速响应) |

实时性(FPS) | 算法每秒处理的帧数 | 总帧数 / 总时间 | ≥25fps(匹配实时视频流) |

五、发展趋势与挑战

现存核心挑战

复杂场景适配:在 “高密度人群(如春运地铁站)” 中,物品被严重遮挡,静态目标提取难度大;

小样本学习:对 “新型遗留物(如折叠轮椅、无人机)”,现有模型缺乏训练数据,检测精度低;

跨摄像头协同:物品从 A 摄像头区域移动到 B 摄像头区域后静止,需实现 “跨镜头目标关联”,避免重复判定或漏判。

未来发展方向

多模态融合:结合 “可见光 + 红外 + 毫米波雷达”,解决光照不足、遮挡问题(如红外可穿透部分遮挡物);

大模型赋能:基于 “视觉大模型(如 GPT-4V、SAM)” 实现 “零样本遗留物检测”(无需针对新物品重新训练);

边缘 - 云端协同:边缘设备实现 “实时检测与预警”,云端实现 “历史数据回溯、模型迭代优化”,平衡实时性与精度;

行为语义理解:从 “单纯检测物品” 升级为 “理解行为意图”(如 “行人反复查看物品后离开” 更可能是遗留,而非临时放置)。

总结

物品遗留与保全检测算法是 “感知智能” 向 “场景智能” 的典型应用,其核心价值在于将 “被动监控” 转化为 “主动预警”。随着计算机视觉技术的发展,该算法将从 “单一物品检测” 走向 “多场景自适应、多风险预判”,为智能安防、智慧园区、无人仓库等领域提供更可靠的安全保障。

需求留言:

需求留言: