联系我们

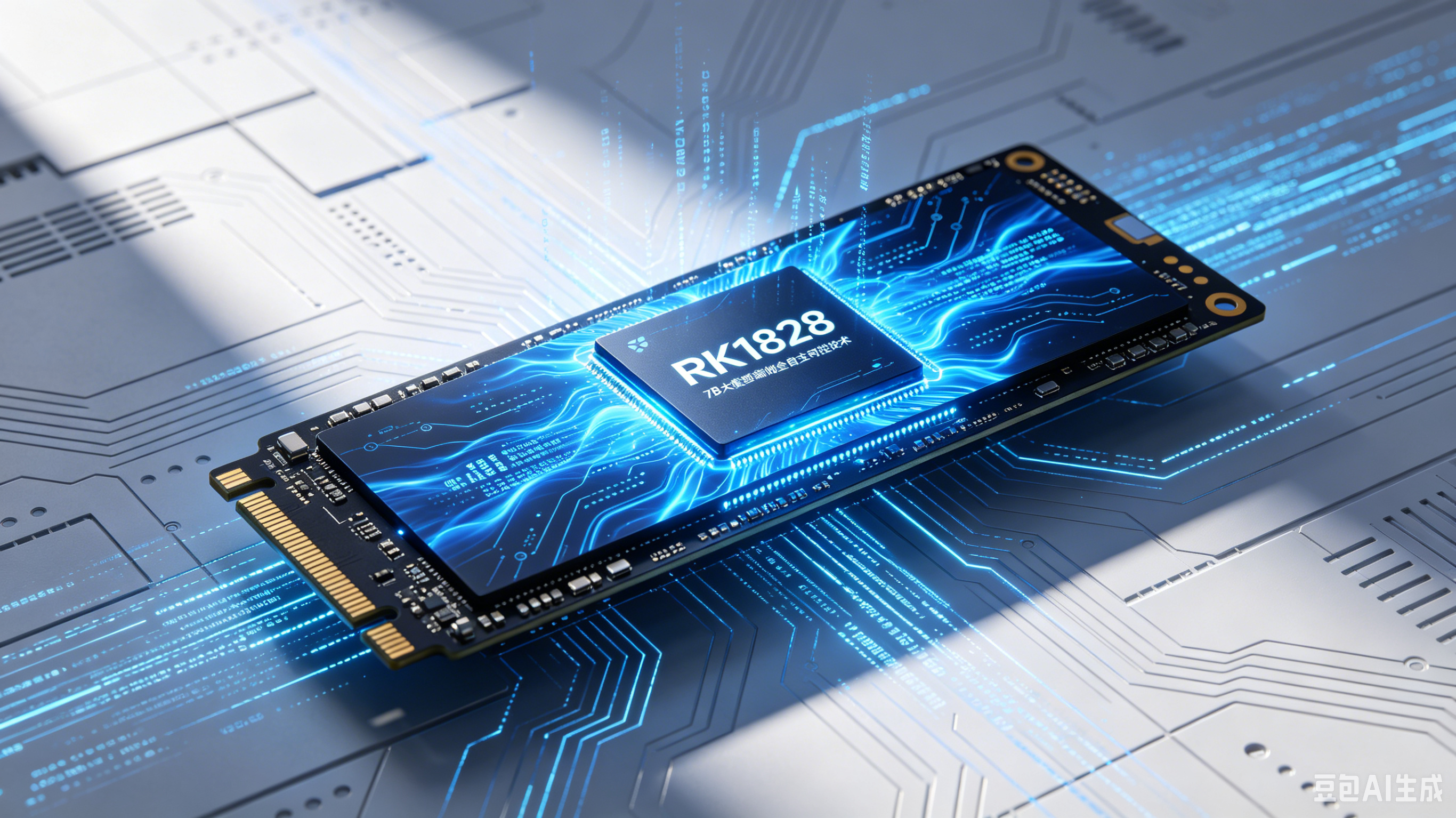

瑞芯微 RK1828 M.2 已实现7B 大模型端侧全自主可控,核心是全国产供应链 + 3D 堆叠 DRAM+M.2 标准形态 + 7B 离线流畅推理,标志国产端侧 AI 算力卡正式进入可用、可控、可量产阶段。

一、核心定位与规格(RK1828 M.2)

产品形态:M.2 2280 Key M PCIe 2.0,即插即用,适配 RK3588 等国产主控。

核心芯片:RK1828(RK182X 系列),5GB 3D 堆叠 DRAM,带宽数百 GB/s,解决大模型 “内存墙”。

算力:峰值20 TOPS(INT8),支持INT4/INT8/INT16多精度。

大模型能力:原生支持7B 参数 LLM(如 Llama 2-7B、Qwen 2.5-7B、通义千问 7B),推理速度 100+ token/s,离线可用。

国产化:中芯国际代工,全国产供应链,性能对标 Jetson Orin Nano、成本低约 30%。

二、技术突破:为什么是里程碑?

1. 3D 堆叠 DRAM:DRAM 直接堆叠在 NPU 上,微米级互联,带宽达数百 GB/s,比传统外挂 DDR 带宽提升数倍、功耗降一个量级,是 7B 模型端侧流畅运行的关键。

2. M.2 标准化:PCIe M.2 形态,像 SSD 一样安装,RK3588+RK1828异构组合,主控管系统、NPU 专做 AI 推理,支持多卡叠加至40 TOPS。

3. 全链路自主可控:芯片设计(瑞芯微)→代工(中芯国际)→封装测试(国产)→M.2 卡量产(国产)→模型适配(国产大模型),无海外卡脖子环节。

4. 生态成熟:支持OpenAI API、主流框架(TensorFlow/PyTorch)、国产模型(通义千问、智谱、Qwen),适配工业视觉、智慧安防、车载、机器人等离线场景。

三、实测表现(2025–2026 公开数据)

Llama 2-7B(INT4):110–130 token/s,单卡流畅对话。

Qwen 2.5-7B(INT8):95–105 token/s,多轮对话稳定。

通义千问 7B:离线部署成功,端侧视频分析 / 摘要秒级响应。

功耗:整卡约10W,边缘设备散热友好。

四、产业意义

端侧 AI 自主可控:摆脱对英伟达 Jetson 依赖,国产设备(工业平板、车载终端、安防 NVR、机器人)可离线跑 7B 大模型,数据不出设备、隐私安全。

成本下探:M.2 卡价格预计数百元级,比 Jetson 方案便宜 30%+,加速 AI 下沉至中小设备。

生态闭环:国产芯片 + 国产大模型 + 国产应用,形成端侧 AI 全栈国产化样板,为后续 13B/34B 模型端侧部署铺路。

五、总结

RK1828 M.2 = 国产端侧 7B 大模型 “标配算力卡”,实现全自主可控、离线流畅推理、标准化 M.2 形态,是国产 AI 芯片从 “能用” 到 “好用” 的关键一步。

需求留言:

需求留言: