联系我们

低误报、高精准的离岗睡岗检测AI,核心是多模态感知+时序行为建模+动态决策,通过抗干扰、强区分、严校验三大技术路径,把“睡岗/离岗”从模糊行为变成可量化、可验证的状态,大幅降低误报。

一、核心痛点与技术目标

1. 场景痛点(高误报根源)

光照干扰:夜间微光、强光反光、明暗交替导致人脸/姿态检测失效。

姿态歧义:短暂低头、闭目养神、倚靠休息,与睡岗高度相似。

行为模糊:短时离岗(喝水、如厕)与长期离岗难以区分。

环境复杂:遮挡、多人、动态背景、设备反光增加识别难度。

2. 技术目标(低误报+高精准)

睡岗:区分“深度入睡”与“短暂休息”,准确率≥95%,误报率<5%。

离岗:区分“短时离开”与“长期脱岗”,区域判定精准,漏检率<3%。

全天候:0.01lux极暗、强光、逆光下稳定识别。

二、关键技术体系(五层架构)

1. 感知层:多模态成像(抗干扰基础)

核心技术

可见光+红外双光融合:可见光抓纹理/姿态,红外抓温度/轮廓,0.01lux极暗环境成像。

全局快门+宽动态(WDR):120dB动态范围,抑制强光/反光,避免运动模糊。

红外补光/热成像:夜间无可见光干扰,精准识别人体轮廓与闭眼状态。

电子稳像+畸变校正:适配顶拍/斜拍/侧拍,保证关键点定位稳定。

2. 目标检测层:精准人体/人脸定位(减少漏检)

主流方案

改进YOLOv8/v10-tiny:轻量化、实时(30fps+),适配边缘设备。

人体姿态估计(MediaPipe/HRNet):定位头部、肩部、躯干、四肢关键点(17点/33点)。

人脸关键点(Face Mesh):68/468点,计算眼纵横比(EAR)、嘴部开合、头部姿态角。

关键优化

小目标增强:针对远距离/小尺寸人体,提升检测召回率。

遮挡鲁棒性:训练戴帽、戴眼镜、侧身、部分遮挡样本。

区域约束:仅在“岗位电子围栏”内检测,排除无关人员。

3. 特征提取层:多维度特征融合(区分本质)

(1)睡岗核心特征(量化指标)

头部姿态:头部下垂角度θ(肩部-头部连线与垂直夹角)

阈值:θ>30°–60°(不同场景可调)

眼部状态:眼纵横比EAR<0.2(闭眼),持续时长占比>70%–80%

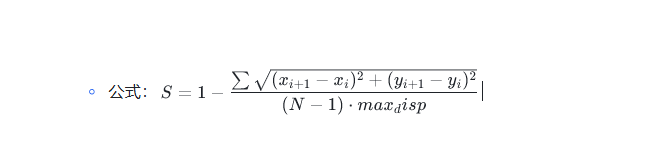

身体静止度:连续N帧(如10–15帧)关键点位移<5–20像素

S≥0.85判定为“持续静止”

行为时序:静止+低头+闭眼的持续时间(如≥2–5分钟)

(2)离岗核心特征

电子围栏判定:人员完全离开“有效岗位区域”(如座椅±0.5–1米)

持续时长:离开时间>阈值(如3–5分钟),短时离开(<1–2分钟)不告警

轨迹验证:结合多帧位置,排除“瞬间出界”“被遮挡误判”

(3)多模态特征融合(降误报核心)

** early fusion**:RGB+红外图像级融合,增强轮廓与纹理。

** middle fusion**:CNN提取各自特征,注意力机制动态加权(α可调)。

** late fusion**:姿态、人脸、时序分数加权融合,输出综合置信度。

4. 时序建模层:动态行为判别(解决歧义)

核心技术:时序行为建模(区分瞬时与持续)

3D卷积+Transformer:建模1–5秒行为序列,捕捉“姿态变化率”。

滑动窗口判定:

睡岗:连续8–15帧满足“低头+闭眼+静止”,才标记为睡岗候选。

离岗:连续多帧出界+无返回,排除“瞬间跨线”。

状态机逻辑:

正常→疑似→确认→告警,逐级验证,避免单帧误判。

引入“恢复机制”:若中途恢复正常姿态,重置计时器。

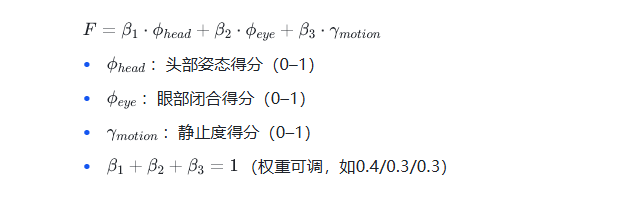

关键公式(睡岗置信度)

5. 决策与预警层:多级校验+低误报策略

低误报核心策略

时间缓冲机制:

睡岗:连续静止≥2–5分钟才告警,区分“闭目养神”与“入睡”。

离岗:离开≥3–5分钟才告警,允许短时离岗。

多条件交叉验证:

睡岗:必须同时满足“低头+闭眼+静止+时长”,缺一不可。

离岗:必须“完全出界+持续时长+轨迹确认”。

自适应阈值:

白天/夜间、强光/弱光下自动调整θ、EAR、静止度阈值。

基于历史行为学习个人习惯,降低个性化误报。

多级预警:

一级:提示(语音/灯光)

二级:告警(推送+记录)

三级:联动(如通知管理人员)

三、算法选型与落地优化

1. 主流算法对比

算法 | 优势 | 劣势 | 适用场景 |

YOLO+MediaPipe | 轻量、实时、易部署 | 复杂时序区分弱 | 边缘端、实时监控 |

3D CNN+Transformer | 时序建模强、误报低 | 计算量大、延迟高 | 服务器端、高精度场景 |

多模态融合(RGB+IR) | 抗光照干扰、鲁棒性强 | 硬件成本高 | 全天候、复杂环境 |

2. 落地关键优化(降误报实战)

数据定制:采集目标场景(值班室/监控室/工厂)的真实样本,包括正常/异常/干扰场景。

模型蒸馏:大模型知识蒸馏到小模型,兼顾精度与速度。

边缘计算:AI盒子本地推理,低延迟、数据隐私、断网可用。

人工闭环:告警需人工确认,反馈数据持续优化模型。

四、效果指标(行业标杆)

睡岗识别:准确率≥96.8%,误报率<5%,区分“短暂休息”与“睡岗”。

离岗检测:准确率≥98%,漏检率<3%,区域判定精准。

环境适应:0.01lux极暗、强光、逆光下稳定运行。

实时性:单路视频延迟<200ms,支持多路并发。

五、总结

低误报、高精准的离岗睡岗检测,本质是**“感知抗干扰+特征强区分+时序严校验+决策缓触发”**的技术组合。通过多模态成像解决环境问题,时序建模解决姿态歧义,多级决策解决误报问题,最终实现“该告警必告警、不该告警绝不乱报”的目标。

需求留言:

需求留言: