联系我们

一、部署总览与核心目标

核心目标

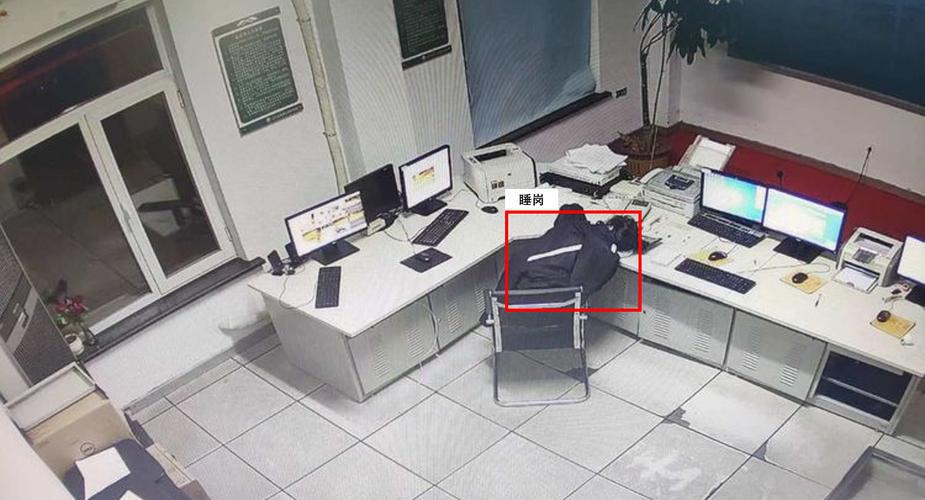

在边缘 AI 盒子上实现低时延(≤50ms)、低功耗、高鲁棒性的离岗/睡岗检测,满足工业值守、安保岗亭、控制室等场景的本地实时推理需求,同时遵循“数据最小化”原则,原始视频边缘端分析后即时丢弃,仅上传事件摘要。

典型架构(三层边缘设计)

层级 | 核心组件 | 核心功能 |

前端感知层 | 720P/1080P 红外补光摄像头、边缘 AI 盒子 | 视频采集、本地推理,数据不出设备 |

算法决策层 | 轻量化检测模型 + 时序决策模块 | 人体定位、眼部状态分析、离岗判定 |

告警与协同层 | 本地语音告警、4G/5G 上行、云端管理平台 | 现场预警、事件上报、模型远程升级 |

二、前期准备:硬件选型与环境适配

1. 边缘 AI 盒子选型(按算力分级)

算力等级 | 推荐芯片/设备 | 适用场景 | 性能预期 |

入门级 | 瑞芯微 RK3568、树莓派 4B | 单路 720P 岗亭值守 | 5–10 FPS,INT8 量化后可跑 15 FPS |

工业级 | 瑞芯微 RK3588、华为 Atlas 500 Pro | 2–4 路 1080P 控制室/车间 | 20–30 FPS,推理延迟 ≤40ms |

高性能 | NVIDIA Jetson Nano/TX2 | 4–8 路 1080P 大型场站 | 30 FPS 稳定,支持多路并发 |

2. 摄像头与安装规范

分辨率:优先 720P(兼顾精度与算力),强光/逆光场景可选 1080P。

补光:红外补光(夜间无红曝),避免强光直射面部导致过曝。

角度:俯视 20°–30°,覆盖整个值守区域,减少背景干扰。

视频流参数:编码 H.265,帧率 5–15 FPS(行为检测无需 30 FPS),码率 ≤1Mbps。

3. 环境与依赖准备

(1)系统配置

烧录 64 位 Debian/Ubuntu 嵌入式系统,开启 SSH 远程管理。

分配硬件资源:NPU/GPU 内存 ≥256MB,开启容器化支持(Docker)。

(2)核心依赖安装

硬件平台 | 推理框架 | 安装命令(示例) |

RK3588(NPU) | MNN/Tengine | pip3 install mnn |

NVIDIA(GPU) | TensorRT | sudo apt install tensorrt python3-libnvinfer |

通用 CPU | ONNX Runtime | pip3 install onnxruntime |

三、算法轻量化:从模型到边缘适配

1. 基础模型选型(轻量化优先)

人体检测:YOLOv10-tiny / YOLOv8n(参数量 ≤5M,适合边缘)。

姿态/眼部关键点:MediaPipe Face Mesh(轻量化,专注面部特征)。

骨干网络:MobileNetV3-Large(较 ResNet50 参数量减少 62%)。

2. 模型压缩三板斧(必做)

(1)知识蒸馏(精度损失 ≤3%)

用大模型(如 YOLOv8x)作为教师,指导小模型(YOLOv8n)学习,模型体积压缩 60%。

# 伪代码:蒸馏训练

from ultralytics import YOLO

teacher = YOLO("yolov8x.pt")

student = YOLO("yolov8n.pt")

student.train(data="sleep_detect.yaml", epochs=20, distill=teacher, loss="distill")

(2)INT8 量化(速度提升 40%+)

用真实场景样本(≥1000 帧)做校准,量化后模型体积缩小 75%,精度损失 ≤1%。

# TensorRT 量化示例(NVIDIA 设备)

trtexec --onnx=sleep_detect.onnx --saveEngine=sleep_detect_int8.engine --int8 --calib=calib_data.txt

(3)模型剪枝(计算量降低 40%)

裁剪冗余卷积层,保留姿态头、时序模块等关键层,避免精度下降。

3. 场景适配优化(解决误报/漏检核心)

(1)动态阈值决策

引入环境亮度因子,低光照时自动降低判定阈值,减少漏检。

# 伪代码:动态阈值

def get_dynamic_threshold(brightness):

base_thresh = 0.5

alpha = 0.2

return base_thresh * (1 + alpha * (1 brightness)) # 亮度越低,阈值越低

(2)时序行为分析

对连续 16 帧提取时空特征,用 BiLSTM 过滤瞬时干扰,避免“眨眼误判睡岗”。

(3)离岗规则配置

电子围栏:划定值守区域,人员完全离开即触发判定。

时间缓冲:短时离岗(<2 分钟)不告警,长时离岗(>3 分钟)标记“疑似离岗”。

四、部署流程:从模型到边缘盒子(分步执行)

阶段 1:模型转换与优化(本地 PC 完成)

1. 导出 ONNX 格式:yolo export model=sleep_detect_n.pt format=onnx imgsz=640。

2. 算子优化:用 onnxsim 简化模型,删除无用节点。

3. 转换为硬件适配格式:

NVIDIA:转换为 TensorRT Engine(.engine)。

RK3588:转换为 MNN 格式(.mnn)。

阶段 2:边缘盒子部署(核心步骤)

(1)容器化部署(推荐,便于运维)

# 1. 拉取推理镜像(以 NVIDIA 为例)

docker pull nvcr.io/nvidia/l4t-base:r32.7.1

# 2. 启动容器(映射模型、视频流端口)

docker run -itd --gpus all \

--name sleep-detect \

-p 8080:8080 \

-v /home/user/models:/models \

-v /home/user/config:/config \

--restart=unless-stopped \

nvcr.io/nvidia/l4t-base:r32.7.1

(2)推理服务开发(轻量级 API)

# 简化版推理脚本(Flask + TensorRT)

from flask import Flask, request, jsonify

import tensorrt as trt

import cv2

app = Flask(__name__)

engine = trt.Runtime(trt.Logger()).deserialize_cuda_engine(open("/models/sleep_detect_int8.engine", "rb").read())

context = engine.create_execution_context()

@app.route("/detect", methods=["POST"])

def detect():

img = cv2.imdecode(np.frombuffer(request.data, np.uint8), cv2.IMREAD_COLOR)

# 预处理 + 推理 + 后处理

result = infer(img, context) # 自定义推理函数

return jsonify(result)

if __name__ == "__main__":

app.run(host="0.0.0.0", port=8080)

(3)视频流接入与告警配置

1. 接入摄像头 RTSP 流:rtsp://admin:123456@192.168.1.100:554/stream1。

2. 配置本地告警:触发时播放语音“请注意保持在岗状态”,音量可调。

3. 事件上报:将事件摘要(时间、类型、持续时间)通过 4G/5G 上传至云端平台。

阶段 3:边云协同配置(可选)

模型升级:云端推送新模型,边缘盒子本地更新,无需现场操作。

远程运维:通过云端平台监控设备状态、推理性能、告警记录。

数据回流:仅上传事件摘要,不传输原始视频,降低带宽成本。

五、性能调优与验收标准

1. 关键调优技巧

优化方向 | 具体操作 | 效果 |

视频流优化 | 降帧至 5–10 FPS,ROI 裁剪(仅分析值守区域) | 算力占用降低 50% |

推理并行 | 单模型多线程处理多路视频,避免 IO 阻塞 | 并发路数提升 2–3 倍 |

内存管理 | 限制容器内存(如 512MB),释放未使用张量 | 避免设备死机 |

2. 验收 KPI(工业级标准)

指标 | 达标值 | 测试场景 |

推理延迟 | ≤50ms | 1080P@10 FPS |

准确率 | ≥92% | 昼夜混合场景 |

误报率 | ≤1 次/天 | 单路视频 24 小时 |

漏检率 | ≤0.1% | 夜班强光屏幕干扰场景 |

六、常见问题与解决方案

问题 | 原因 | 解决方案 |

夜间漏检严重 | 光照不足,眼部特征模糊 | 开启红外补光,模型量化时保留眼部关键点层 |

离岗误报 | 人员短暂离开(如倒水) | 增加 2 分钟时间缓冲,设置“免扰时段” |

推理速度慢 | 帧率过高、模型未量化 | 降帧至 5–10 FPS,执行 INT8 量化 |

设备死机 | 内存溢出、算力过载 | 容器化资源限制,裁剪模型冗余层 |

七、部署清单(一键核对)

1. 硬件:边缘 AI 盒子(已烧录系统)、红外摄像头、电源、网线。

2. 模型:量化后的 ONNX/TensorRT/MNN 模型文件。

3. 软件:Docker、推理框架(TensorRT/MNN)、轻量级 API 服务。

4. 配置:视频流 RTSP 地址、离岗时间阈值、告警音量、云端上报接口。

5. 测试:昼夜场景测试、误报/漏检测试、性能压力测试。

总结

边缘计算 + 离岗睡岗检测的轻量化部署核心是**“模型做减法,硬件做适配,场景做优化”**。通过知识蒸馏、INT8 量化、模型剪枝压缩模型,结合边缘 AI 盒子的硬件特性做推理优化,再通过动态阈值、时序分析解决场景痛点,可实现工业级的实时、精准检测。建议先以单路视频试点,验证 KPI 达标后再批量扩展,降低部署风险。

需求留言:

需求留言: