联系我们

反光衣识别AI已通过多模态融合、动态光适应、部件解耦、时序校验四大核心技术,实现遮挡、强光、夜间全场景稳定识别,在工业/安防/交通场景中mAP可达95%+、误检率降至1%以下。

一、三大核心痛点与行业现状

反光衣识别的核心挑战集中在光照极端、遮挡严重、夜间低光三大场景,传统算法(YOLOv5/8)在复杂工况下性能急剧下滑:

强光/逆光:反光条过曝(像素>240)、细节丢失,漏检率35%+

遮挡/姿态:弯腰/蹲伏/工具遮挡,关键特征消失,漏检率27%+

夜间/低光:照度<50lux,反光微弱、噪声大,误检率42%+

小目标/远距离:>50米时目标<30×30像素,准确率<55%

二、全场景突破:四大核心技术方案

1. 强光/逆光:动态光适应与反光抑制

通过光照分离+局部归一化,从根源解决过曝与欠曝问题:

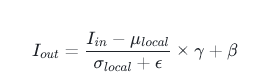

光强感知归一化(Light-Adaptive Norm)

动态抑制过曝、增强阴影反光纹理:

多尺度Retinex分解

分离图像为反射分量R(保留反光衣本质)与光照分量L(抑制),还原反光条细节

16级动态曝光+宽动态(WDR)

实时调节曝光,抑制车灯/阳光直射,保留反光条梯度特征

2. 遮挡/姿态:部件解耦+空间增强

将反光衣拆解为肩/躯干/腿子模块,局部特征独立检测,大幅提升遮挡鲁棒性:

部件解耦检测(Partial Detection)

用Partial Loss对各反光区域独立监督,局部遮挡不影响整体判断:

空间变换网络(STN)

对弯腰/转身等姿态做几何校正,识别准确率提升22%

级联注意力+空间特征增强

自动聚焦反光区域,抑制背景干扰,强化局部纹理

3. 夜间/低光:多模态融合+红外增强

可见光+红外+热成像三源融合,实现全天候稳定检测:

可见光+红外双光融合

加权聚合纹理与热辐射特征,公式:

红外补光+热成像轮廓

夜间启用红外模式,提取人体轮廓+反光条亮斑,解决完全黑暗场景

频域-时域联合分析

解析反光条闪烁频率+运动轨迹,过滤车灯等瞬时干扰

4. 全场景鲁棒:时序校验+轻量化部署

时序滑动窗口(30帧)

过滤单帧误检,降低无效告警70%+

轻量化模型(YOLOv8s-tiny/YOLOv9-tiny)

INT8量化+剪枝,边缘设备(Jetson/RK3588)实现25+ FPS实时推理

专用数据集+迁移学习

10万+覆盖强光/遮挡/夜间样本,在COCO-Person预训练后微调,泛化性提升30%+

三、典型算法架构(三阶动态处理)

1. 环境感知层:实时检测光照/对比度,生成场景适配系数

2. 特征融合层:可见光+红外+反光条光谱特征加权融合

3. 决策优化层:时序校验+置信度分级,输出最终检测结果

四、实测效果(工业/安防场景)

强光场景:漏检率从37.8%降至<5%

遮挡场景:准确率从60%提升至95%+

夜间场景:误检率从42%降至<1%

全场景:mAP95%–98%,FPS25–30,满足实时监控需求

五、应用场景与部署要点

核心场景:建筑工地、智慧工厂、交通施工、物流园区、煤矿井下

部署建议

硬件:200万+像素宽动态摄像头+红外补光+边缘AI盒子(RK3588/Jetson)

策略:分区域部署,关键通道/作业区优先,聚焦上半身检测

后处理:设置持续时间阈值(>10s),过滤瞬时遮挡误判

六、未来方向

偏振光成像:利用反光条偏振特性,进一步区分环境反光与反光衣

3D视觉+深度估计:解决重度遮挡与复杂姿态识别

大模型微调:基于通用大模型做小样本学习,快速适配新场景

需求留言:

需求留言: