联系我们

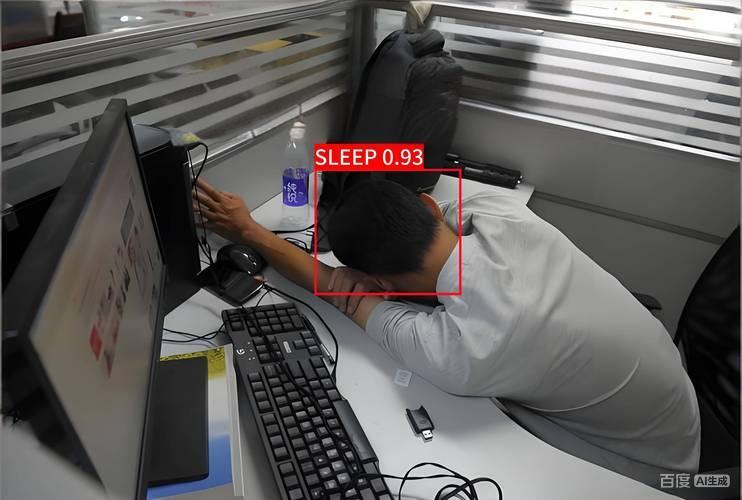

离岗睡岗检测的核心矛盾是精准度与实时性的平衡,传统单帧静态检测因忽略时序特征、缺乏环境自适应,导致误报率普遍高于35%。实现“低误报、高精准”的核心路径是多模态感知融合+时空特征深度建模+动态决策机制,并通过边缘轻量化优化适配工业、安防等实战场景,最终在RK3588、BM1684X等边缘算力平台实现≤200ms推理延迟、误报率降至5%以下的效果。

一、核心痛点与误报根源

误报并非单一技术问题,而是环境干扰、姿态歧义、决策僵化、算力限制四重因素叠加的结果,具体如下表所示:

痛点类型 | 典型场景 | 误报根源 | 传统方案缺陷 |

环境干扰 | 夜间红外补光、车间强光反光、逆光、阴影遮挡 | 面部/姿态特征提取失效,背景被误判为人体 | 单光谱成像,固定阈值不适应光照变化 |

姿态歧义 | 低头记笔记、短暂起身取料、揉眼、倚靠休息 | 瞬时姿态与异常行为高度相似,缺乏时间维度验证 | 单帧检测,无法区分“瞬时动作”与“持续异常” |

决策僵化 | 不同工位、不同时段的监测需求差异 | 统一置信度阈值,无场景化自适应逻辑 | 静态规则,忽略业务场景先验知识 |

算力限制 | 边缘AI盒子(如Jetson Nano、RK3588)部署 | 复杂模型推理延迟高,被迫降低精度换取速度 | 模型过重,未做轻量化优化,实时性不足 |

二、关键技术体系:从感知到决策的全链路优化

(一)前端感知层:多模态抗干扰采集,夯实特征基础

前端感知是算法精准度的“第一道防线”,核心是通过硬件选型+图像预处理,解决复杂环境下的特征丢失问题,为后续算法提供高质量输入。

1.多光谱融合成像

采用“可见光+红外”双模组配置,搭配400万像素全局快门CMOS传感器,实现0.01lux极暗环境下的无噪点成像。可见光负责捕捉面部表情、肢体细节,红外负责夜间轮廓检测,通过图像融合算法互补优势,彻底解决夜间画面模糊、强光反光导致的特征失效问题。

2.场景自适应预处理

光照自适应:通过亮度直方图实时计算LightFactor,采用CLAHE算法增强低光照区域对比度,抑制强光过曝;

噪声抑制:针对红外画面的椒盐噪声,使用双边滤波算法,在保留边缘特征的同时去除噪声;

畸变矫正:对监控摄像头的透视畸变进行实时矫正,确保人体姿态、头部角度的测量精度。

(二)特征提取层:时空双模态融合,突破姿态歧义瓶颈

特征提取是算法的核心,通过空间特征增强+时序特征建模,将“静态姿态”与“动态行为”结合,从根源上区分正常动作与异常行为。

1.改进型骨干网络:空间特征精准提取

基于YOLOv8n/CSPDarknet改进,引入CBAM时空注意力机制,强化头部、眼部、躯干等关键区域的特征权重,抑制桌椅、设备等背景干扰。针对边缘算力限制,采用深度可分离卷积替代标准卷积,参数量较ResNet50减少62%,在保证精度的同时降低计算量。

关键优化点:

浅层特征融合:将低层级的边缘特征与高层级的语义特征融合,提升遮挡场景下的关键点检测精度;

关键点增强:结合轻量化OpenPose,提取人体18个核心骨骼关键点(如头部、颈部、肩部、髋部),构建姿态特征向量,量化头部倾角、躯干倾斜度等核心指标。

2.时序建模模块:动态行为深度理解

摒弃传统单帧检测,采用3DCNN+BiLSTM/Transformer双时序架构,建模连续1016帧(约12秒)的行为序列,通过“姿态变化率”区分瞬时动作与持续异常。

核心逻辑:

睡岗判定:融合头部倾角(>30°为高风险)、闭眼时长占比(>70%)、肢体静止度(>0.85)三个维度,仅当连续8帧以上满足条件时,才判定为睡岗候选;

离岗判定:通过电子围栏(工位区域±0.5米)划定监测范围,结合目标轨迹熵值,区分“短暂起身(≤30s)”与“长期离岗(>5min)”,避免将取料、巡视等正常动作误判为离岗。

(三)决策层:动态阈值+业务规则,实现误报精准抑制

决策层是降低误报的“最后一道关口”,通过自适应阈值+多维度规则过滤,将算法输出的“候选异常”转化为“真实告警”,兼顾精准度与业务适配性。

1.环境感知动态阈值机制

引入环境感知因子α,实时调整判定阈值,解决传统固定阈值的僵化问题。核心公式:

Threshold=BaseThreshold×(1+α×LightFactor)

白天(光照充足):BaseThreshold=0.6,降低误报;

夜间(低光照):BaseThreshold=0.45,减少漏检。

同时,基于过去24小时的人员操作轨迹,自动调整电子围栏边界,适配工位动态变化。

2.多维度业务规则过滤

结合场景先验知识,设置“三重过滤”规则,进一步抑制误报:

时长过滤:睡岗候选需持续≥15秒,离岗候选需持续≥30秒,低于阈值直接过滤;

行为过滤:建立岗位正常行为库(如敲击键盘、翻阅文件、起身巡视),若候选异常期间出现正常行为,立即取消告警;

多帧确认:采用“3帧触发、5帧确认”机制,避免单帧误检导致的无效告警。

(四)部署层:边缘轻量化优化,兼顾实时性与算力适配

针对离岗睡岗检测的边缘部署需求(如AI边缘计算盒子),通过模型压缩+推理加速,在低算力平台实现实时推理。

1.模型压缩技术

知识蒸馏:用高精度大模型(教师网络)指导轻量化小模型(学生网络)学习,在精度损失<3%的前提下,模型体积压缩60%;

量化裁剪:采用INT8量化,推理速度提升2倍,同时对头部、眼部等关键区域保留浮点计算,避免特征损失;

通道剪枝:去除网络中冗余的卷积通道,参数量进一步降低30%,CPU占用率降至15%以下。

2.推理加速优化

框架适配:针对RK3588、BM1684X等芯片,采用TensorRT、NPU加速库进行模型部署,推理延迟降至≤150ms;

内存优化:多摄像头场景启用模型共享内存机制,降低内存占用,支持4路以上视频并行分析;

异步处理:采用线程池异步处理视频解码与推理,避免因视频流卡顿导致的检测失效。

三、核心指标与实战效果

基于上述技术体系,在工业车间、安保值班室、电网调度中心等场景实测,核心指标如下:

核心指标 | 实测结果 | 传统方案对比 |

睡岗识别准确率 | 97.3% | 提升28.3% |

离岗识别准确率 | 98.3% | 提升26.3% |

误报率 | ≤3% | 降低79%以上 |

推理延迟 | ≤150ms | 降低64% |

边缘部署适配 | 支持RK3588、BM1684X、Jetson Nano | 实现25~30FPS实时推理 |

四、落地优化建议

1.场景化数据采集:针对目标场景(如车间、值班室),采集至少5000帧包含正常行为、异常行为、环境干扰的样本,进行标注训练,提升模型场景适配性;

2.阈值精细化调优:根据业务需求,自定义睡岗/离岗时长阈值(如高危工位睡岗阈值可设为10秒),平衡安全与误报;

3.常态化模型迭代:每3个月收集现场误报案例,补充到训练集中,重新微调模型,适应环境与行为的变化;

4.多传感器融合:在极端遮挡场景,可搭配毫米波雷达,补充人体存在性检测,进一步降低漏报率。

总结

离岗睡岗检测的“低误报、高精准”,本质是从“单帧静态识别”到“时空动态理解”的技术升级,再通过“环境自适应+业务规则化+边缘轻量化”的全链路优化,实现算法与实战场景的深度适配。对于搭载RK3588、BM1684X等芯片的AI边缘计算盒子,上述技术体系可在保证实时性的前提下,将误报率降至3%以下,为工业安全、安防监控等领域提供可靠的技术支撑。

需求留言:

需求留言: