联系我们

一、核心目标与关键指标

核心目标:在边缘/端云协同架构下,实现低延迟、高精准的实时视频异常侦测,支撑安防、工业质检、智慧园区等场景的快速响应与决策。

关键指标:端到端延迟≤100ms;单路1080P视频实时性≥25fps;目标检测/行为识别准确率≥95%,误报率≤5%;边缘设备内存占用≤512MB、算力<1TOPS。

二、整体架构选型

(一)架构对比与推荐

架构类型 | 适用场景 | 核心优势 | 核心局限 |

纯边缘部署 | 小型园区、工厂车间、隐私敏感场景 | 超低延迟(<50ms)、隐私数据不出本地、带宽占用极低 | 单节点算力有限,复杂场景精度一般 |

端云协同 | 中大型园区、多站点、复杂行为分析 | 边缘初筛+云端复核,兼顾速度与精准度,支持模型集中迭代 | 需稳定网络,云端成本略高 |

纯云端部署 | 算力充足、非实时响应场景 | 模型能力强、数据集中管理 | 延迟高(>500ms)、带宽成本高、隐私风险大 |

推荐方案:优先端云协同架构,边缘节点负责快速初筛与事件触发,云端负责复杂行为分析与模型迭代,平衡实时性、精准度与成本。

(二)端云协同架构分层

1. 感知层:摄像头(支持RTSP/Onvif)+ 边缘计算设备(AI盒子/服务器),负责视频流采集、初步解码与轻量化推理。

2. 边缘分析层:部署轻量化异常检测模型,完成目标检测、轨迹追踪、规则判定(如区域入侵、徘徊、跌倒),仅上传异常片段/关键帧至云端。

3. 云端分析层:部署高精度模型,对边缘上报的异常进行二次复核,生成行为意图分析、历史数据统计,支撑全局策略优化。

4. 决策联动层:对接声光报警、门禁、安保平台,实现异常事件的即时推送与联动处置。

三、算法选型与轻量化优化

(一)核心算法选型

任务类型 | 推荐算法 | 选型理由 | 适用场景 |

目标检测 | YOLOv8n/YOLOv10n(INT8量化) | 体积小(<10MB)、推理速度快(200ms/帧内)、支持开放词汇检测 | 人员、车辆、物品等目标识别 |

行为识别 | 轻量化Transformer/LSTM + 原型正交模型 | 捕捉时序依赖,支持弱监督训练,适配多场景异常判定 | 跌倒、打架、违规操作、区域入侵 |

异常评分 | 时序异常检测模型(ST-GCN/Event VAD) | 基于正常行为模式建模,精准识别偏离正常的异常行为 | 无明确异常类别、需自适应场景 |

(二)模型轻量化核心技术

1. 模型压缩

剪枝:通道剪枝移除冗余滤波器,参数量减少60%+,保留核心特征。

量化:FP32→INT8混合精度量化,模型体积压缩至1/4,推理速度提升1.8-3倍,精度损失控制在1%以内。

知识蒸馏:用大模型(教师)指导小模型(学生)训练,小模型FLOPs下降60%,AUC仅下降2-3个百分点。

2. 推理加速

硬件适配:NVIDIA Jetson系列用TensorRT优化,延迟从87ms降至22ms;ARM平台用OpenVINO/ONNX Runtime加速。

图优化:算子融合、消除冗余计算,内存占用减少40%+。

动态输入:支持可变尺寸帧输入,适配不同分辨率视频,提升推理效率。

四、部署全流程方案

(一)部署前准备

1. 环境搭建

边缘设备:Ubuntu 20.04+,安装CUDA 11.8/CUDNN 8.9、OpenCV 4.8、ONNX Runtime 1.17、PyTorch 2.0。

云端服务器:GPU(T4/V100)+ 容器化环境(Docker/K8s),部署模型管理平台(如TorchServe)。

2. 数据与模型准备

采集场景专属视频数据(覆盖白天/黑夜、晴雨/雾等环境),标注目标框、行为类别、异常标签。

对模型进行场景微调,重点优化低照、遮挡、快速移动目标的识别能力。

生成ONNX格式模型,完成量化与推理引擎编译。

(二)边缘端部署步骤

1. 摄像头接入

配置摄像头RTSP地址(海康:rtsp://admin:密码@IP:554/Streaming/Channels/101;大华:rtsp://admin:密码@IP:554/cam/realmonitor?channel=1&subtype=0),测试连通性。

用OpenCV/JavaCV解码视频流,设置帧采样频率(10-25fps),平衡性能与覆盖率。

2. 模型部署与推理

加载轻量化模型(如YOLOv8n-INT8),配置检测阈值(0.65)、NMS参数(IoU阈值0.45)。

实现实时推理流程:帧采集→预处理(缩放、归一化)→模型推理→后处理(目标框筛选、轨迹追踪)→异常判定。

部署规则引擎:配置异常规则(如“区域A入侵+未戴安全帽→报警”),支持500+条复杂逻辑组合。

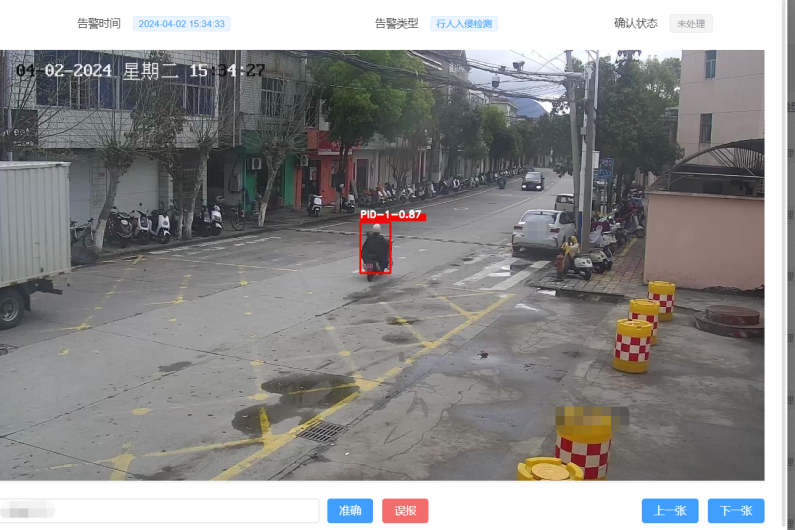

3. 告警与数据上报

异常触发时,生成结构化告警信息(时间、位置、目标信息、关键帧),推送至本地控制台与云端。

仅上传异常片段(每段5-10秒),带宽占用降低90%+。

(三)云端部署步骤

1. 模型服务化

封装高精度异常检测模型为REST/gRPC接口,支持批量推理、异步处理。

对接边缘上报数据,进行二次复核,过滤误报,提升精准度。

2. 模型迭代与管理

收集边缘端异常数据与反馈,进行增量训练,优化模型泛化能力。

实现模型版本管理、灰度发布、自动回滚,保障业务连续性。

3. 数据与运维

存储异常视频片段、告警日志,支持多维度检索与统计分析。

监控边缘节点状态(CPU/内存/带宽)、推理延迟、告警准确率,自动告警异常。

五、性能优化与稳定性保障

(一)核心优化策略

1. 负载均衡

多边缘节点协同处理多路视频,按设备算力动态分配任务,避免单点过载。

云端采用GPU集群+容器弹性伸缩,应对高峰时段推理请求。

2. 动态适配

针对数据分布漂移(如场景变化、环境变化),部署在线增量学习机制,精度衰减率降低42%。

支持模型动态下发,按区域/场景定制模型规则(工厂侧重设备异常,商场侧重拥挤检测)。

3. 异常处理

边缘节点故障时,自动切换备用节点,保障业务不中断。

网络抖动时,本地缓存异常数据,网络恢复后补传。

(二)稳定性保障措施

1. 容错机制

边缘端:本地缓存模型与配置,断网时仍可独立推理与告警。

云端:多副本部署,主备切换,避免单点故障。

2. 安全合规

隐私保护:原始视频数据本地处理,不上传云端,符合数据合规要求。

数据加密:传输(TLS 1.3)与存储(AES-256)加密,防止数据泄露。

3. 监控与告警

监控指标:推理延迟、帧率、资源占用、告警准确率、漏报/误报率。

告警渠道:短信、邮件、企业微信/钉钉,支持自定义告警阈值。

六、测试与验收标准

(一)测试场景与指标

测试项 | 测试内容 | 验收标准 |

实时性测试 | 单路1080P视频推理延迟、端到端响应时间 | 延迟≤100ms,帧率≥25fps |

精准度测试 | 目标检测、行为识别、异常评分准确率 | 准确率≥95%,误报率≤5%,漏报率≤3% |

负载测试 | 16路/32路视频并发推理、边缘高负载 | 单节点稳定运行,无崩溃,延迟波动≤20% |

稳定性测试 | 7×24小时连续运行、断网/断电恢复 | 无数据丢失,恢复后正常推理,告警无遗漏 |

(二)测试流程

1. 单元测试:验证模型推理、规则引擎、数据上报等模块功能正常。

2. 集成测试:测试端云协同、告警联动、模型更新等流程顺畅。

3. 压力测试:模拟高并发场景,验证系统负载能力与稳定性。

4. 场景验收:在真实场景中测试不同环境(低照、遮挡、复杂行为)下的表现。

七、落地实施路径

1. 试点阶段(1-2周)

选择1-2个高风险区域(如仓库入口、生产流水线)部署,验证算法效果与性能。

收集试点数据,优化模型与规则,调整参数(检测阈值、NMS参数)。

2. 推广阶段(2-4周)

批量部署边缘设备,接入所有摄像头,实现区域全覆盖。

上线云端分析与模型迭代平台,支撑全局管理与优化。

3. 运维阶段(长期)

建立7×24小时运维团队,监控系统状态,快速处理故障。

定期更新模型与规则,适配场景变化,持续提升精准度。

八、关键工具与资源

模型工具:Ultralytics YOLO、ONNX Runtime、TensorRT、OpenVINO、PyTorch Lightning。

部署工具:Docker、K3s、Portainer、Prometheus+Grafana(监控)。

数据工具:Label Studio(标注)、FFmpeg(视频处理)、MinIO(对象存储)。

参考资源:UCF-Crime、ShanghaiTech等异常检测数据集;Event VAD、CLIP-TSA等前沿模型论文。

九、风险与应对

风险类型 | 具体风险 | 应对措施 |

技术风险 | 模型精度不足、误报/漏报高 | 场景专属微调、数据增强、多模型融合复核 |

部署风险 | 边缘设备算力不足、延迟超标 | 进一步模型压缩、优化推理引擎、升级边缘硬件 |

运维风险 | 断网导致数据丢失、告警中断 | 本地缓存、断点续传、备用网络、自动告警 |

合规风险 | 隐私数据泄露、违规采集 | 本地处理、数据加密、合规标注、权限管理 |

十、总结

本方案以端云协同为核心,通过轻量化模型优化、硬件适配加速、负载均衡与容错机制,实现实时视频异常侦测的高效部署与稳定运行。落地时需优先试点,快速迭代,结合场景需求定制模型与规则,最终实现“低延迟、高精准、易运维”的目标,支撑业务高效运转。

需求留言:

需求留言: