联系我们

160TOPS 并非噱头,而是在 10W 超低功耗下,存算一体架构带来的真实能效优势;但它是端侧专用卡,不能跟显卡 / 云端卡直接比。

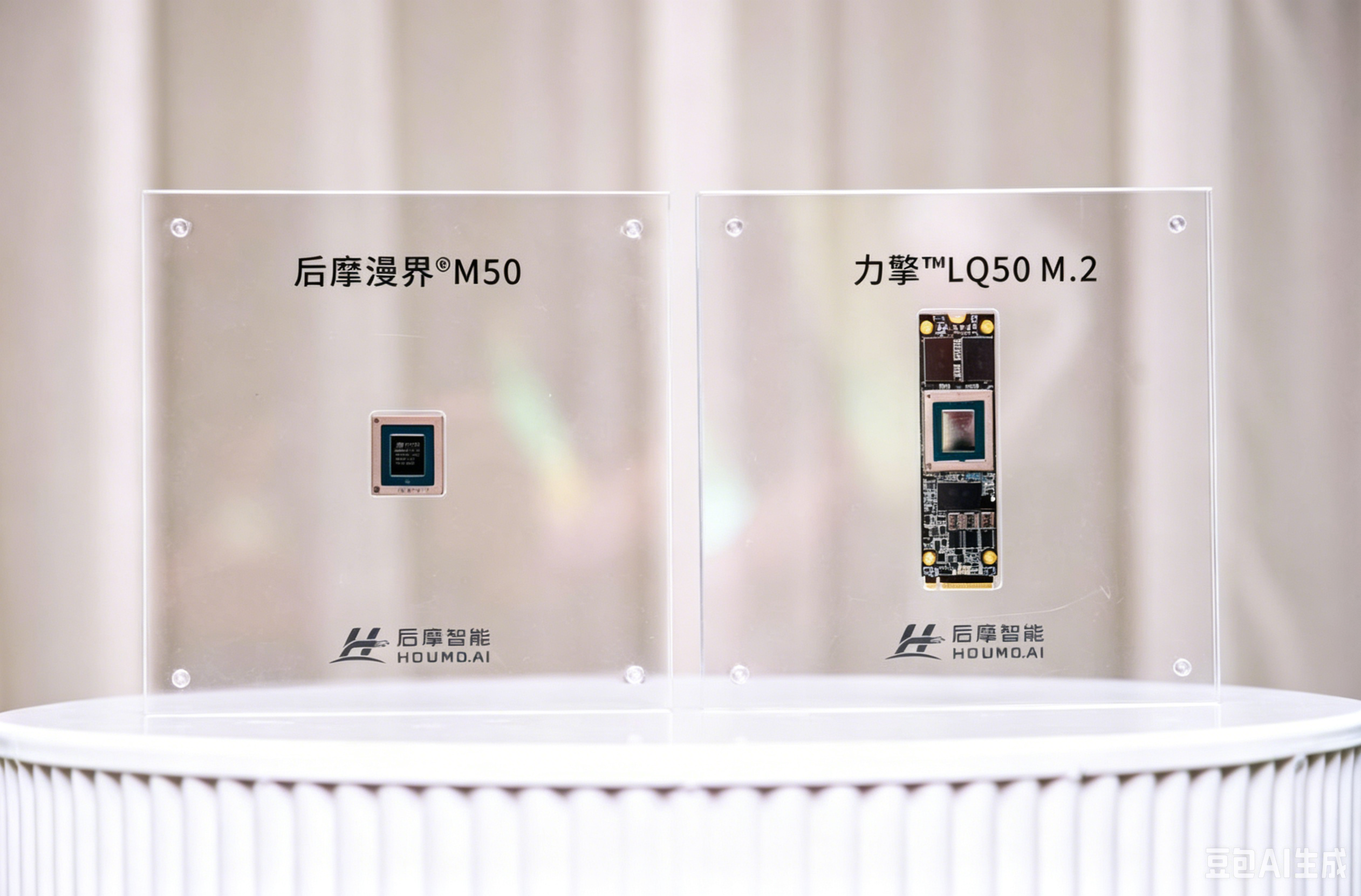

一、核心规格(官方数据,2025 年 7 月发布)

算力:160TOPS(INT8)、100TFLOPS(bFP16)

功耗:典型 10W(无风扇被动散热)

内存:48GB LPDDR5,带宽 153.6GB/s

形态:M.2 2280,口香糖大小,即插即用

推理性能:7B/8B 模型>25 tokens/s;可跑 14B 模型

二、160TOPS 是 “真” 的吗?(怎么看)

1. 架构决定真实性

用的是存算一体(CIM),不是传统 GPU/NPU。计算直接在内存里做,能效比传统架构高 5–10 倍。

10W 下 160TOPS:同功耗下,传统 GPU(如 RTX 4060)只有约 30–40TOPS,能效碾压。

2. 不是 “纸面算力”

现场演示:单卡流畅运行千问 14B做公文写作、会议纪要。

实测 7B 模型>25 tokens/s,接近云端轻量部署水平,且本地离线、低延迟、隐私可控。

3. 局限:端侧专用,非全能

不能玩游戏、不能做专业渲染;只擅长 AI 推理(大模型、视觉分析)。

INT8 是 AI 常用精度,160TOPS 在端侧 INT8 赛道是第一梯队。

三、对比:是强,但场景不同

vs 同功耗端侧 NPU(如笔记本集成 NPU):强 3–5 倍,48GB 大内存可跑更大模型。

vs 入门 GPU(如 RTX 3050 70W):算力(160 vs 120TOPS)略高,功耗仅 1/7,且本地大模型更友好。

vs 云端 A100(400W):算力差很多,但功耗 1/40、成本低、可离线,场景完全不同。

四、适合谁?不适合谁

✅ 适合

AI PC / 本地大模型:离线跑 7B–14B,25+ tokens/s,10W 无风扇。

边缘设备:机器人、工业视觉、32 路视频分析,低功耗 + 高算力 + 离线。

隐私优先:数据不出本地,低延迟响应。

❌ 不适合

游戏 / 渲染 / 训练:只做推理,不支持训练。

超大规模模型(>34B):单卡不够,需多卡(LQ50 Duo 320TOPS)。

五、总结:真强,但有边界

160TOPS 是真实的端侧能效冠军:10W 下无敌手,存算一体架构带来5–10 倍能效提升。

不是全能卡,是端侧 AI 专用加速器:本地大模型、边缘视觉、隐私计算场景非常能打。

噱头?否。真强?是,但仅限端侧推理场景。

需求留言:

需求留言: